lbjlaq/Antigravity-Manager

Professional Antigravity Account Manager & Switcher. One-click seamless account switching for Antigravity Tools. Built with Tauri v2 + React (Rust).专业的 Antigravity 账号管理与切换工具。为 Antigravity 提供一键无缝账号切换功能。

Loading star history...

Health Score

75

Weekly Growth

+0

+0.0% this week

Contributors

1

Total contributors

Open Issues

1.6K

Generated Insights

About Antigravity-Manager

Antigravity Tools 🚀

专业的 AI 账号管理与协议反代系统 (v4.0.7)

Antigravity Tools 是一个专为开发者和 AI 爱好者设计的全功能桌面应用。它将多账号管理、协议转换和智能请求调度完美结合,为您提供一个稳定、极速且成本低廉的 本地 AI 中转站。

通过本应用,您可以将常见的 Web 端 Session (Google/Anthropic) 转化为标准化的 API 接口,消除不同厂商间的协议鸿沟。

💖 赞助商 (Sponsors)

| 感谢 PackyCode 对本项目的赞助!PackyCode 是一家可靠高效的 API 中转服务商,提供 Claude Code、Codex、Gemini 等多种服务的中转。PackyCode 为本项目的用户提供了特别优惠:使用此链接注册,并在充值时输入 “Ctrler” 优惠码即可享受 九折优惠。 |

|---|

☕ 支持项目 (Support)

如果您觉得本项目对您有所帮助,欢迎打赏作者!

| 支付宝 (Alipay) | 微信支付 (WeChat) | Buy Me a Coffee |

|---|---|---|

|  |  |

🌟 深度功能解析 (Detailed Features)

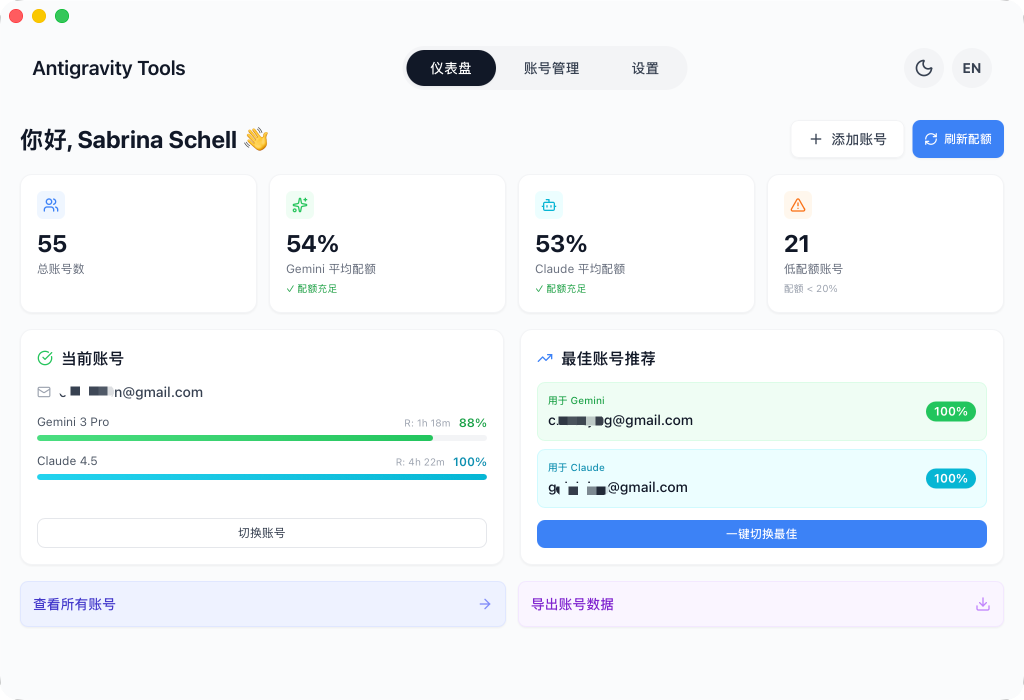

1. 🎛️ 智能账号仪表盘 (Smart Dashboard)

- 全局实时监控: 一眼洞察所有账号的健康状况,包括 Gemini Pro、Gemini Flash、Claude 以及 Gemini 绘图的 平均剩余配额。

- 最佳账号推荐 (Smart Recommendation): 系统会根据当前所有账号的配额冗余度,实时算法筛选并推荐“最佳账号”,支持 一键切换。

- 活跃账号快照: 直观显示当前活跃账号的具体配额百分比及最后同步时间。

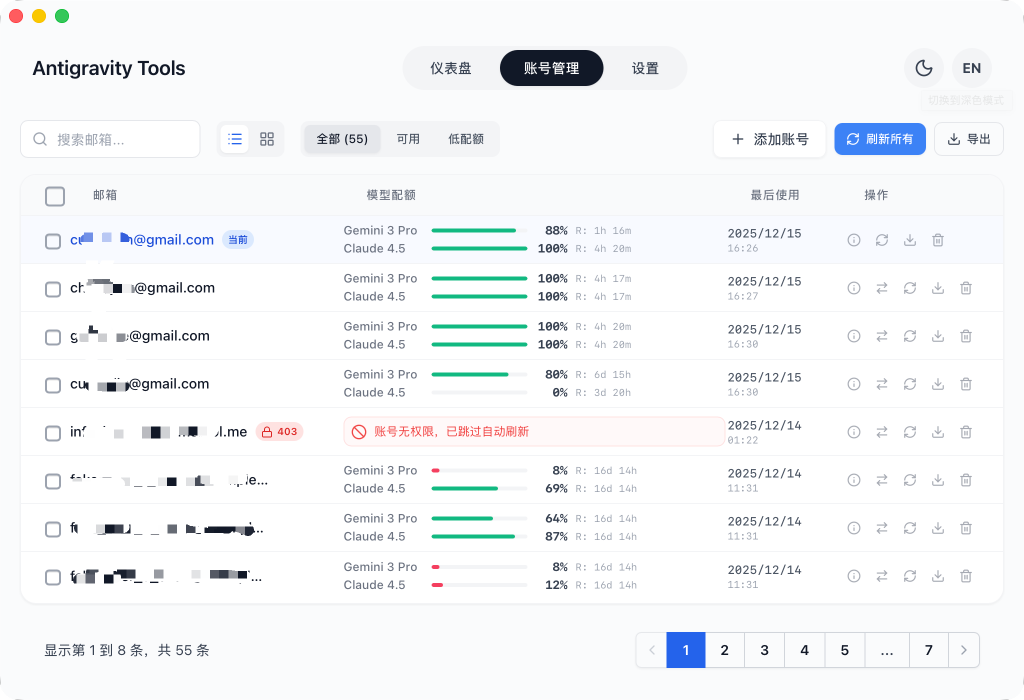

2. 🔐 强大的账号管家 (Account Management)

- OAuth 2.0 授权(自动/手动): 添加账号时会提前生成可复制的授权链接,支持在任意浏览器完成授权;回调成功后应用会自动完成并保存(必要时可点击“我已授权,继续”手动收尾)。

- 多维度导入: 支持单条 Token 录入、JSON 批量导入(如来自其他工具的备份),以及从 V1 旧版本数据库自动热迁移。

- 网关级视图: 支持“列表”与“网格”双视图切换。提供 403 封禁检测,自动标注并跳过权限异常的账号。

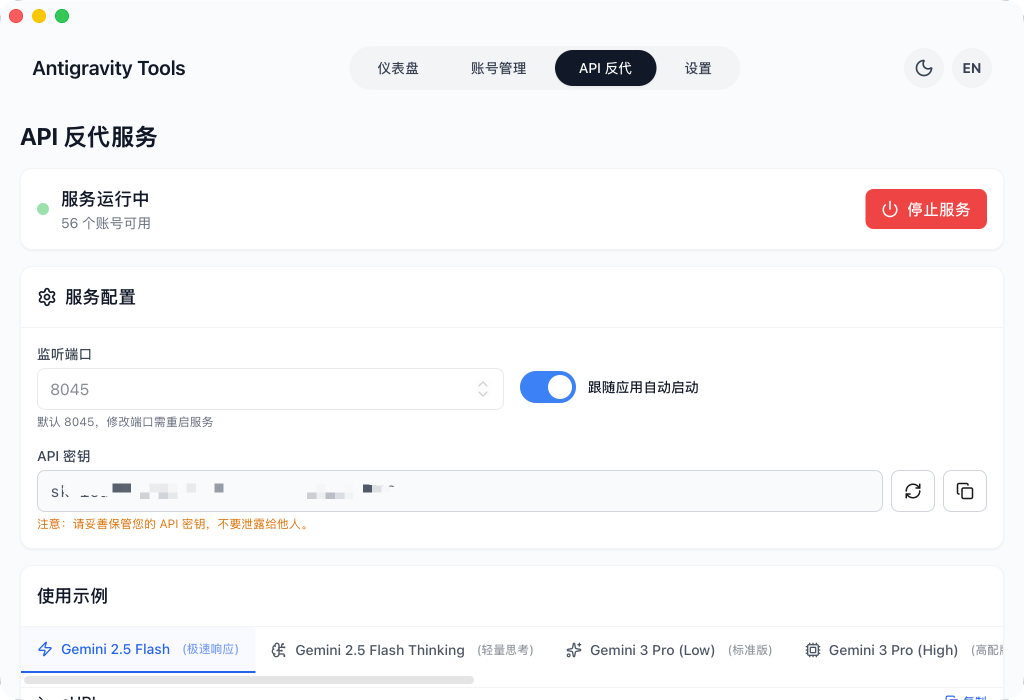

3. 🔌 协议转换与中继 (API Proxy)

- 全协议适配 (Multi-Sink):

- OpenAI 格式: 提供

/v1/chat/completions端点,兼容 99% 的现有 AI 应用。 - Anthropic 格式: 提供原生

/v1/messages接口,支持 Claude Code CLI 的全功能(如思思维链、系统提示词)。 - Gemini 格式: 支持 Google 官方 SDK 直接调用。

- OpenAI 格式: 提供

- 智能状态自愈: 当请求遇到

429 (Too Many Requests)或401 (Expire)时,后端会毫秒级触发 自动重试与静默轮换,确保业务不中断。

4. 🔀 模型路由中心 (Model Router)

- 系列化映射: 您可以将复杂的原始模型 ID 归类到“规格家族”(如将所有 GPT-4 请求统一路由到

gemini-3-pro-high)。 - 专家级重定向: 支持自定义正则表达式级模型映射,精准控制每一个请求的落地模型。

- 智能分级路由 (Tiered Routing): [新] 系统根据账号类型(Ultra/Pro/Free)和配额重置频率自动优先级排序,优先消耗高速重置账号,确保高频调用下的服务稳定性。

- 后台任务静默降级: [新] 自动识别 Claude CLI 等工具生成的后台请求(如标题生成),智能重定向至 Flash 模型,保护高级模型配额不被浪费。

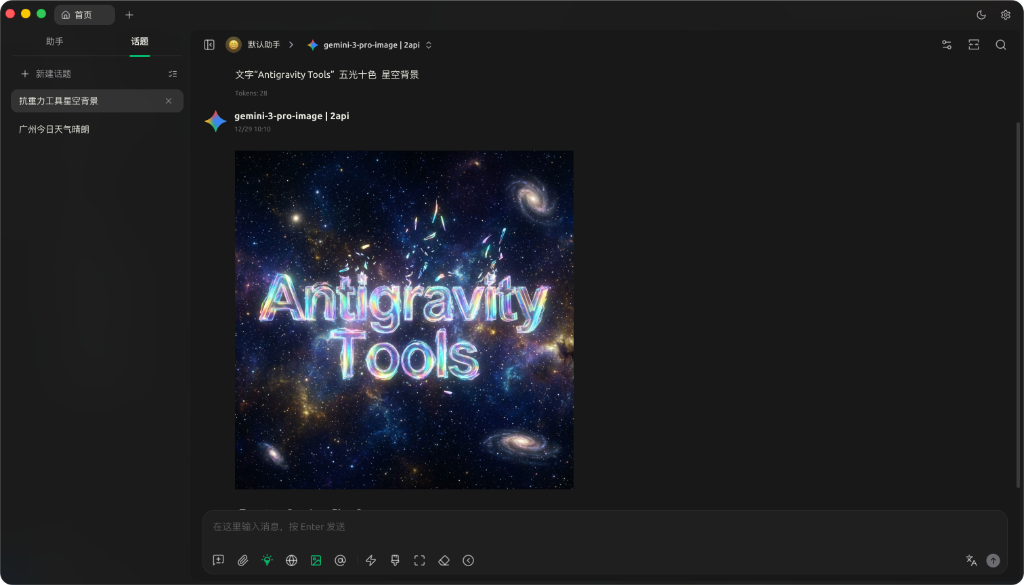

5. 🎨 多模态与 Imagen 3 支持

- 高级画质控制: 支持通过 OpenAI

size(如1024x1024,16:9) 参数自动映射到 Imagen 3 的相应规格。 - 超强 Body 支持: 后端支持高达 100MB (可配置) 的 Payload,处理 4K 高清图识别绰绰有余。

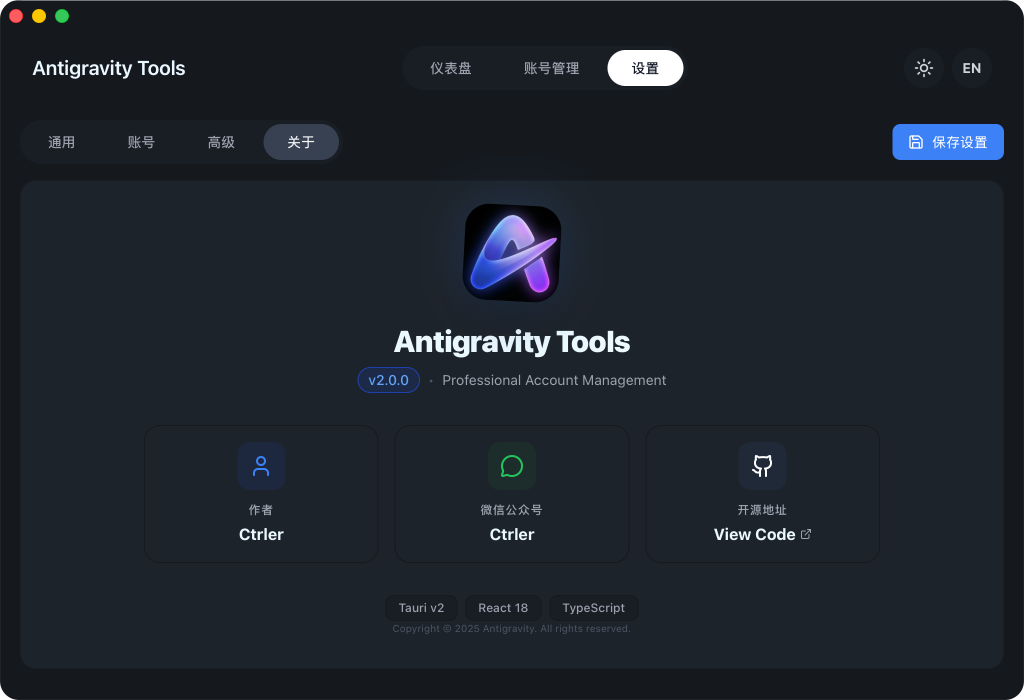

📸 界面导览 (GUI Overview)

仪表盘 |  账号列表 |

关于页面 |  API 反代 |

系统设置 |

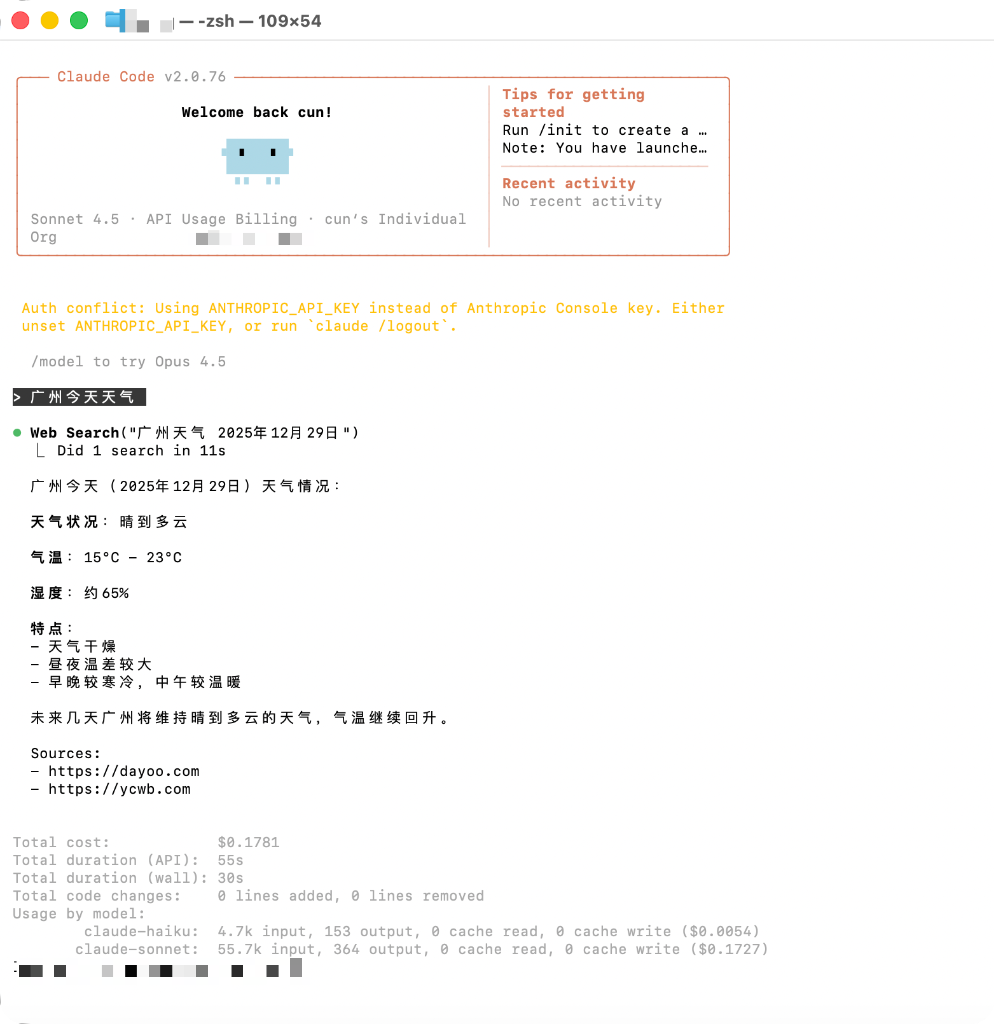

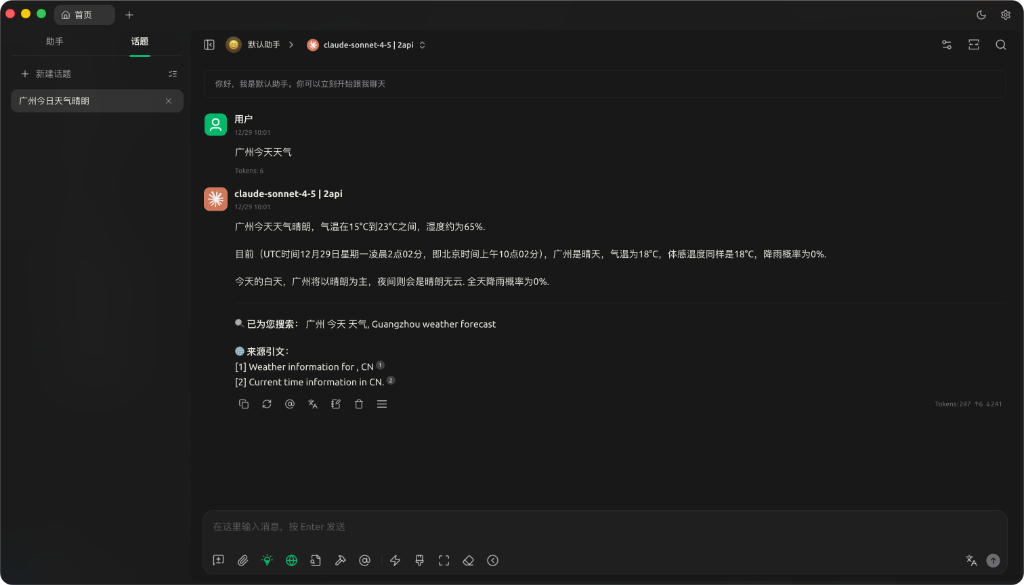

💡 使用案例 (Usage Examples)

Claude Code 联网搜索 |  Cherry Studio 深度集成 |

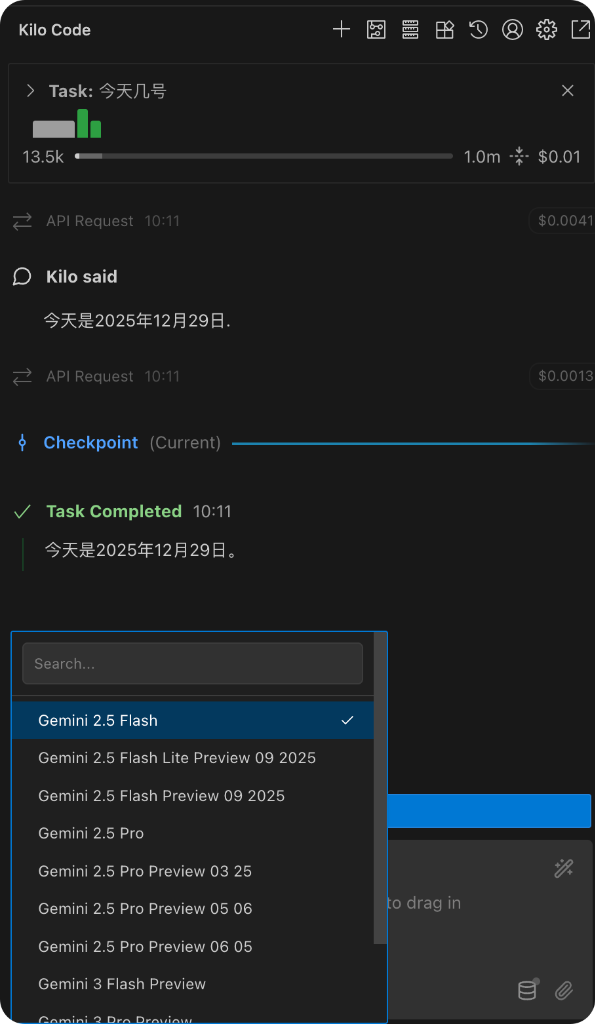

Imagen 3 高级绘图 |  Kilo Code 接入 |

🏗️ 技术架构 (Architecture)

graph TD

Client([外部应用: Claude Code/NextChat]) -->|OpenAI/Anthropic| Gateway[Antigravity Axum Server]

Gateway --> Middleware[中间件: 鉴权/限流/日志]

Middleware --> Router[Model Router: ID 映射]

Router --> Dispatcher[账号分发器: 轮询/权重]

Dispatcher --> Mapper[协议转换器: Request Mapper]

Mapper --> Upstream[上游请求: Google/Anthropic API]

Upstream --> ResponseMapper[响应转换器: Response Mapper]

ResponseMapper --> Client

安装指南 (Installation)

选项 A: 终端安装 (macOS & Linux 推荐)

macOS

如果您已安装 Homebrew,可以通过以下命令快速安装:

# 1. 订阅本仓库的 Tap

brew tap lbjlaq/antigravity-manager https://github.com/lbjlaq/Antigravity-Manager

# 2. 安装应用

brew install --cask antigravity-tools

提示: 如果遇到权限问题,建议添加

--no-quarantine参数。

Arch Linux

您可以选择通过一键安装脚本或 Homebrew 进行安装:

方式 1:一键安装脚本 (推荐)

curl -sSL https://raw.githubusercontent.com/lbjlaq/Antigravity-Manager/main/deploy/arch/install.sh | bash

方式 2:通过 Homebrew (如果您已安装 Linuxbrew)

brew tap lbjlaq/antigravity-manager https://github.com/lbjlaq/Antigravity-Manager

brew install --cask antigravity-tools

其他 Linux 发行版

安装后会自动将 AppImage 添加到二进制路径并配置可执行权限。

选项 B: 手动下载

前往 GitHub Releases 下载对应系统的包:

- macOS:

.dmg(支持 Apple Silicon & Intel) - Windows:

.msi或 便携版.zip - Linux:

.deb或AppImage

选项 C: Docker 部署 (推荐用于 NAS/服务器)

如果您希望在容器化环境中�运行,我们提供了原生的 Docker 镜像。该镜像内置了对 v4.0.2 原生 Headless 架构的支持,可自动托管前端静态资源,并通过浏览器直接进行管理。

# 方式 1: 直接运行 (推荐)

# - API_KEY: 必填。用于所有协议的 AI 请求鉴定。

# - WEB_PASSWORD: 可选。用于管理后台登录。若不设置则默认使用 API_KEY。

docker run -d --name antigravity-manager \

-p 8045:8045 \

-e API_KEY=sk-your-api-key \

-e WEB_PASSWORD=your-login-password \

-e ABV_MAX_BODY_SIZE=104857600 \

-v ~/.antigravity_tools:/root/.antigravity_tools \

lbjlaq/antigravity-manager:latest

# 忘记密钥?执行 docker logs antigravity-manager 或 grep -E '"api_key"|"admin_password"' ~/.antigravity_tools/gui_config.json

#### 🔐 鉴权逻辑说明

* **场景 A:仅设置了 `API_KEY`**

- **Web 登录**:使用 `API_KEY` 进入后台。

- **API 调用**:使用 `API_KEY` 进行 AI 请求鉴权。

* **场景 B:同时设置了 `API_KEY` 和 `WEB_PASSWORD` (推荐)**

- **Web 登录**:**必须**使用 `WEB_PASSWORD`,使用 API Key 将被拒绝(更安全)。

- **API 调用**:统一使用 `API_KEY`。这样您可以将 API Key 分发给成员,而保留密码仅供管理员使用。

#### 🆙 旧版本升级指引

如果您是从 v4.0.1 及更早版本升级,系统默认未设置 `WEB_PASSWORD`。您可以通过以下任一方式设置:

1. **Web UI 界面 (推荐)**:使用原有 `API_KEY` 登录后,在 **API 反代设置** 页面手动设置并保存。新密码将持久化存储在 `gui_config.json` 中。

2. **环境变量 (Docker)**:在启动容器时增加 `-e WEB_PASSWORD=您的新密码`。**注意:环境变量具有最高优先级,将覆盖 UI 中的任何修改。**

3. **配置文件 (持久化)**:直接修改 `~/.antigravity_tools/gui_config.json`,在 `proxy` 对象中修改或添加 `"admin_password": "您的新密码"` 字段。

- *注:`WEB_PASSWORD` 是环境变量名,`admin_password` 是配置文件中的 JSON 键名。*

> [!TIP]

> **密码优先级逻辑 (Priority)**:

> - **第一优先级 (环境变量)**: `ABV_WEB_PASSWORD` 或 `WEB_PASSWORD`。只要设置了环境变量,系统将始终使用它。

> - **第二优先级 (配置文件)**: `gui_config.json` 中的 `admin_password` 字段。UI 的“保存”操作会更新此值。

> - **保底回退 (向后兼容)**: 若上述均未设置,则回退使用 `API_KEY` 作为登录密码。

# 方式 2: 使用 Docker Compose

# 1. 进入项目的 docker 目录

cd docker

# 2. 启动服务

docker compose up -d

访问地址:

http://localhost:8045(管理后台) |http://localhost:8045/v1(API Base) 系统要求:

- 内存: 建议 1GB (最小 256MB)。

- 持久化: 需挂载

/root/.antigravity_tools以保存数据。- 架构: 支持 x86_64 和 ARM64。 详情见: Docker 部署指南 (docker)

Copyright © 2024-2026 lbjlaq

🛠️ 常见问题排查 (Troubleshooting)

macOS 提示“应用已损坏,无法打开”?

由于 macOS 的安全机制,非 App Store 下载的应用可能会触发此提示。您可以按照以下步骤快速修复:

- 命令行修复 (推荐):

打开终端,执行以下命令:

sudo xattr -rd com.apple.quarantine "/Applications/Antigravity Tools.app" - Homebrew 安装技巧:

如果您使用 brew 安装,可以添加

--no-quarantine参数来规避此问题:brew install --cask --no-quarantine antigravity-tools

🔌 快速接入示例

🔐 OAuth 授权流程(添加账号)

- 打开“Accounts / 账号” → “添加账号” → “OAuth”。

- 弹窗会在点击按钮前预生成授权链接;点击链接即可复制到系统剪贴板,然后用你希望的浏览器打开并完成授权。

- 授权完成后浏览器会打开本地回调页��并显示“✅ 授权成功!”。

- 应用会自动继续完成授权并保存账号;如未自动完成,可点击“我已授权,继续”手动完成。

提示:授权链接包含一次性回调端口,请始终使用弹窗里生成的最新链接;如果授权时应用未运行或弹窗已关闭,浏览器可能会提示

localhost refused connection。

如何接入 Claude Code CLI?

- 启动 Antigravity,并在“API 反代”页面开启服务。

- 在终端执行:

export ANTHROPIC_API_KEY="sk-antigravity"

export ANTHROPIC_BASE_URL="http://127.0.0.1:8045"

claude

如何接入 Kilo Code?

- 协议选择: 建议优先使用 Gemini 协议。

- Base URL: 填写

http://127.0.0.1:8045。 - 注意:

- OpenAI 协议限制: Kilo Code 在使用 OpenAI 模式时,其请求路径会叠加产生

/v1/chat/completions/responses这种非标准路径,导致 Antigravity 返回 404。因此请务必填入 Base URL 后选择 Gemini 模式。 - 模型映射: Kilo Code 中的模型名称可能与 Antigravity 默认设置不一致,如遇到无法连接,请在“模型映射”页面设置自定义映射,并查看日志文件进行调试。

- OpenAI 协议限制: Kilo Code 在使用 OpenAI 模式时,其请求路径会叠加产生

如何在 Python 中使用?

import openai

client = openai.OpenAI(

api_key="sk-antigravity",

base_url="http://127.0.0.1:8045/v1"

)

response = client.chat.completions.create(

model="gemini-3-flash",

messages=[{"role": "user", "content": "你好,请自我介绍"}]

)

print(response.choices[0].message.content)

如何使用图片生成 (Imagen 3)?

方式一:OpenAI Images API (推荐)

import openai

client = openai.OpenAI(

api_key="sk-antigravity",

base_url="http://127.0.0.1:8045/v1"

)

# 生成图片

response = client.images.generate(

model="gemini-3-pro-image",

prompt="一座未来主义风格的城市,赛博朋克,霓虹灯",

size="1920x1080", # 支持任意 WIDTHxHEIGHT 格式,自动计算宽高比

quality="hd", # "standard" | "hd" | "medium"

n=1,

response_format="b64_json"

)

# 保存图片

import base64

image_data = base64.b64decode(response.data[0].b64_json)

with open("output.png", "wb") as f:

f.write(image_data)

支持的参数:

size: 任意WIDTHxHEIGHT格式(如1280x720,1024x1024,1920x1080),自动计算并映射到标准宽高比(21:9, 16:9, 9:16, 4:3, 3:4, 1:1)quality:"hd"→ 4K 分辨率(高质量)"medium"→ 2K 分辨率(中等质量)"standard"→ 默认分辨率(标准质量)

n: 生成图片数量(1-10)response_format:"b64_json"或"url"(Data URI)

方式二:Chat API + 参数设置 (✨ 新增)

所有协议(OpenAI、Claude)的 Chat API 现在都支持直接传递 size 和 quality 参数:

# OpenAI Chat API

response = client.chat.completions.create(

model="gemini-3-pro-image",

size="1920x1080", # ✅ 支持任意 WIDTHxHEIGHT 格式

quality="hd", # ✅ "standard" | "hd" | "medium"

messages=[{"role": "user", "content": "一座未来主义风格的城市"}]

)

# Claude Messages API

curl -X POST http://127.0.0.1:8045/v1/messages \

-H "Content-Type: application/json" \

-H "x-api-key: sk-antigravity" \

-d '{

"model": "gemini-3-pro-image",

"size": "1280x720",

"quality": "hd",

"messages": [{"role": "user", "content": "一只可爱的猫咪"}]

}'

参数优先级: 请求体参数 > 模型后缀

方式三:Chat 接口 + 模型后缀

response = client.chat.completions.create(

model="gemini-3-pro-image-16-9-4k", # 格式:gemini-3-pro-image-[比例]-[质量]

messages=[{"role": "user", "content": "一座未来主义风格的城市"}]

)

模型后缀说明:

- 宽高比:

-16-9,-9-16,-4-3,-3-4,-21-9,-1-1 - 质量:

-4k(4K),-2k(2K), 不加后缀(标准) - 示例:

gemini-3-pro-image-16-9-4k→ 16:9 比例 + 4K 分辨率

方式四:Cherry Studio 等客户端设置

在支持 OpenAI 协议的客户端(如 Cherry Studio)中,可以通过模型设置页面配置图�片生成参数:

- 进入模型设置:选择

gemini-3-pro-image模型 - 配置参数:

- Size (尺寸): 输入任意

WIDTHxHEIGHT格式(如1920x1080,1024x1024) - Quality (质量): 选择

standard/hd/medium - Number (数量): 设置生成图片数量(1-10)

- Size (尺寸): 输入任意

- 发送请求:直接在对话框中输入图片描述即可

参数映射规则:

size: "1920x1080"→ 自动计算为16:9宽高比quality: "hd"→ 映射为4K分辨率quality: "medium"→ 映射为2K分辨率

📝 开发者与社区

-

版本演进 (Changelog):

-

v4.0.7 (2026-01-29):

-

[性能优化] 优化 Docker 构建流程 (Fix Issue #1271):

- 原生架构构建: 将 AMD64 和 ARM64 的构建任务拆分为独立 Job 并行执行,并移除 QEMU 模拟层,转而使用各架构原生的 GitHub Runner。此举将跨平台构建耗时从 3 小时大幅缩减至 10 分钟以内。

-

[性能优化] 解决 Docker 版本在大数据量下的卡顿与崩溃问题 (Fix Issue #1269):

- 异步数据库操作: 将流量日志、Token 统计等所有耗时数据库查询迁移至后台阻塞线程池 (

spawn_blocking),彻底解决了在查看大型日志文件(800MB+)时可能导致的 UI 卡死及反代服务不可用的问题。 - 监控逻辑平滑化: 优化了监控状态切换逻辑,移除冗余的重复启动记录,提升了 Docker 环境��下的运行稳定性。

- 异步数据库操作: 将流量日志、Token 统计等所有耗时数据库查询迁移至后台阻塞线程池 (

-

[核心修复] 解决 OpenAI 协议 400 Invalid Argument 错误 (Fix Issue #1267):

- 移除激进默认值: 回滚了 v4.0.6 中为 OpenAI/Claude 协议引入的默认

maxOutputTokens: 81920设置。该值超过了许多旧模型(如gemini-3-pro-preview或原生 Claude 3.5)的硬性限制,导致请求被直接拒绝。 - 智能思维配置: 优化了思维模型检测逻辑,仅对以

-thinking结尾的模型自动注入thinkingConfig,避免了对不支持该参数的标准模型(如gemini-3-pro)产生副作用。

- 移除激进默认值: 回滚了 v4.0.6 中为 OpenAI/Claude 协议引入的默认

-

[兼容性修复] 修复 OpenAI Codex (v0.92.0) 调用错误 (Fix Issue #1278):

- 字段清洗: 自动过滤 Codex 客户端在工具定义中注入的非标准

external_web_access字段,消除了 Gemini API 返回的 400 Invalid Argument 错误. - 容错增强: 增加了对工具

name字段的强制校验。当客户端发送缺失名称的无效工具定义时,代理层现在会自动跳过并记录警告,而不是直接让请求失败。

- 字段清洗: 自动过滤 Codex 客户端在工具定义中注入的非标准

-

[核心功能] 自适应熔断器 (Adaptive Circuit Breaker):

- 模型级隔离: 实现了基于

account_id:model的复合 Key 限流追踪,确保单一模型的配额耗尽不会导致整个账号被锁定。 - 动态退避策略: 支持用户自定义

[60, 300, 1800, 7200]等多级退避阶梯,自动根据失败次数增加锁定时间。 - 配置热更新: 配合

TokenManager内存缓存,实现配置修改后反代服务即刻生效,无需重启。 - 管理 UI 集成: 在 API 反代页面新增了完整的控制面板,支持一键开关及手动清�除限流记录。

- 模型级隔离: 实现了基于

-

[核心优化] 完善日志清理与冗余压制 (Fix Issue #1280):

- 自动空间回收: 引入基于体积的清理机制,当日志目录超过 1GB 时自动触发清理,并将占用降至 512MB 以内。相比原有的按天清理,能从根本上防止因日志爆发导致的磁盘撑爆问题。

- 高频日志瘦身: 将 OpenAI 处理器报文详情、TokenManager 账号池轮询等高频产生的日志级别从 INFO 降级为 DEBUG。现在 INFO 级别仅保留简洁的请求摘要。

-

-

v4.0.6 (2026-01-28):

- [核心修复] 彻底解决 Google OAuth "Account already exists" 错误:

- 持久化升级: 将授权成功后的保存逻辑从“仅新增”升级为

upsert(更新或新增) 模式。现在重新授权已存在的账号会平滑更新其 Token 和项目信息,不再弹出报错。

- 持久化升级: 将授权成功后的保存逻辑从“仅新增”升级为

- [核心修复] 修复 Docker/Web 模式下手动回填授权码失效问题:

- Flow 状态预初始化: 在 Web 模式生成授权链接时,后端会同步初始化 OAuth Flow 状态。这确保了在 Docker 等无法自动跳转的环境下,手动复制回填授权码或 URL 能够被后端正确识别并处理。

- [体验优化] 统一 Web 与桌面端的 OAuth 持久化路径: 重构了

TokenManager,确保所有平台共用同一套健壮的账号核验与存储逻辑。 - [性能优化] 优化限流恢复机制 (PR #1247):

- 自动清理频率: 将限流记录的后台自动清理间隔从 60 秒缩短至 15 秒,大幅提升了触发 429 或 503 错误后的业务恢复速度。

- 智能同步清理: 优化了单个或全部账号刷新逻辑,确保刷新账号的同时即刻清除本地限流锁定,使最新配额能立即投入使用。

- 渐进式容量退避: 针对

ModelCapacityExhausted错误(如 503),将原有的固定 15 秒重试等待优化为[5s, 10s, 15s]阶梯式策略,显著减少了偶发性容量波动的等待时间。

- [核心修复] 窗口标题栏深色模式适配 (PR #1253): 修复了在系统切换为深色模式时,应用标题栏(Titlebar)未能同步切换配色,导致视觉不统一的问题。

- [核心修复] 提升 Opus 4.5 默认输出上限 (Fix Issue #1244):

- 突破限制: 将 Claude 和 OpenAI 协议的默认

max_tokens从 16k 提升至 81,920 (80k)。 - 解决截断: 彻底解决了 Opus 4.5 等模型在开启思维模式时,因默认 Budget 限制导致输出被锁定在 48k 左右的截断问题。现在无需任何配置即可享受完整的长文本输出能力。

- 突破限制: 将 Claude 和 OpenAI 协议的默认

- [核心修复] 修复账号删除后的幽灵数据问题 (Ghost Account Fix):

- 同步重载: 修复了账号文件被删除后,反代服务的内存缓存未同步更新,导致已删账号仍参与轮询的严重 Bug。

- 即时生效: 现在单删或批量删除账号后,会强制触发反代服务重载,确保内存中的账号列表与磁盘实时一致。

- [核心修复] Cloudflared 隧道启动问题修复 (Fix PR #1238):

- 启动崩溃修复: 移除了不支持的命令行参数 (

--no-autoupdate/--loglevel),解决了 cloudflared 进程启动即退出的问题。 - URL 解析修正: 修正了命名隧道 URL 提取时的字符串偏移量错误,确保生成的访问链接格式正确。

- Windows 体验优化: 为 Windows 平台添加了

DETACHED_PROCESS标志,实现了隧道的完全静默后台运行,消除了弹窗干扰。

- 启动崩溃修复: 移除了不支持的命令行参数 (

- [核心修复] 彻底解决 Google OAuth "Account already exists" 错误:

-

v4.0.5 (2026-01-28):

- [核心修复] 彻底解决 Docker/Web 模式 Google OAuth 400 错误 (Google OAuth Fix):

- 协议对齐: 强制所有模式(包括 Docker/Web)使用

localhost作为 OAuth 重定向 URI,绕过了 Google 对私网 IP 和非 HTTPS 环境的拦截策略。 - 流程优化: 配合已有的“手动授权码回填”功能,确保即使在远程服务器部署环境下,用户也能顺利完成 Google 账号的授权与添加。

- 协议对齐: 强制所有模式(包括 Docker/Web)使用

- [功能增强] 新增阿拉伯语支持与 RTL 布局适配 (PR #1220):

- 国际化拓展: 新增完整的阿拉伯语 (

ar) 翻译支持。 - RTL 布局: 实现了自动检测并适配从右向左 (Right-to-Left) 的 UI 布局。

- 排版优化: 引入了 Effra 字体家族,显著提升了阿拉伯语文本的可读性与美观度。

- 国际化拓展: 新增完整的阿拉伯语 (

- [功能增强] 手动清除限流记录 (Clear Rate Limit Records):

- 管理 UI 集成: 在“代理设置 -> 账号轮换与会话调度”区域新增了“清除限流记录”按钮,支持桌面端与 Web 端调用,允许用户手动清除所有账号的本地限流锁(429/503 记录)。

- 账号列表联动: 实现了配额与限流的智能同步。现在刷新账号额度(单个或全部)时,会自动清除本地限流状态,确保最新的额度信息能立即生效。

- 后端核心逻辑: 在

RateLimitTracker和TokenManager中底层实现了手动与自动触发的清除逻辑,确保高并发下的状态一致性。 - API 支持: 新增了对应的 Tauri 命令与 Admin API (

DELETE /api/proxy/rate-limits),方便开发者进行编程化管理与集成。 - 强制重试: 配合清除操作,可强制下一次请求忽略之前的退避时间,直接尝试连接上游,帮助在网络恢复后快速恢复业务。

- [核心修复] 彻底解决 Docker/Web 模式 Google OAuth 400 错误 (Google OAuth Fix):

-

v4.0.4 (2026-01-27):

- [功能增强] 深度集成 Gemini 图像生成与多协议支持 (PR #1203):

- OpenAI 兼容性增强: 支持通过标准 OpenAI Images API (

/v1/images/generate) 调用 Gemini 3 图像模型,支持size、quality等参数。 - 多协议集成: 增强了 Claude 和 OpenAI Chat 接口,支持直接传递图片生成参数,并实现了自动宽高比计算与 4K/2K 质量映射。

- 文档补全: 新增

docs/gemini-3-image-guide.md,提供完整的 Gemini 图像生成集成指南。 - 稳定性优化: 优化了通用工具函数 (

common_utils.rs) 和 Gemini/OpenAI 映射逻辑,确保大尺寸 Payload 传输稳定。

- OpenAI 兼容性增强: 支持通过标准 OpenAI Images API (

- [核心修复] 对齐 OpenAI 重试与限流逻辑 (PR #1204):

- 逻辑对齐: 重构了 OpenAI 处理器的重试、限流及账号轮换逻辑,使其与 Claude 处理器保持一致,显著提升了高并发下的稳定性。

- 热重载优化: 确保 OpenAI 请求在触发 429 或 503 错误时能精准执行退避策略并自动切换可用账号。

- [核心修复] 修复 Web OAuth 账号持久化问题 (Web Persistence Fix):

- 索引修复: 解决了在 Web 管理界面通过 OAuth 添加的账号虽然文件已生成,但未同步更新到全局账号索引 (

accounts.json),导致重启后或桌面端无法识别的问题。 - 锁机制统一: 重构了

TokenManager的保存逻辑,复用了modules::account的核心方法,确保了文件锁与索引更新的原子性。

- 索引修复: 解决了在 Web 管理界面通过 OAuth 添加的账号虽然文件已生成,但未同步更新到全局账号索引 (

- [核心修复] 解决 Google OAuth 非 Localhost 回调限制 (Fix Issue #1186):

- 问题背景: Google 不支持在 OAuth 流程中使用非 localhost 私网 IP 作为回调地址,即便注入

device_id也会报“不安全的应用版本”警告。 - 解决方案: 引入了标准化的“手动 OAuth 提交”流程。当浏览器无法自动回调至本地(如远程部署或非 Localhost 环境)时,用户可直接复制回调链接或授权码至应用内完成授权。

- 体验增强: 重构了手动提交界面,集成了全语言国际化支持(9 国语言)与 UI 优化,确保在任何网络环境下都能顺利添加账号。

- 问题背景: Google 不支持在 OAuth 流程中使用非 localhost 私网 IP 作为回调地址,即便注入

- [核心修复] 解决 Google Cloud Code API 429 错误 (Fix Issue #1176):

- 智能降级: 默认将 API 流量迁移至更稳定的 Daily/Sandbox 环境,避开生产环境 (

cloudcode-pa.googleapis.com) 当前频繁的 429 错误。 - 稳健性提升: 实现了 Sandbox -> Daily -> Prod 的三级降级策略,确保主业务流程在极端网络环境下的高可用性。

- 智能降级: 默认将 API 流量迁移至更稳定的 Daily/Sandbox 环境,避开生产环境 (

- [核心优化] 账号调度算法升级 (Algorithm Upgrade):

- 健康评分系统 (Health Score): 引入了 0.0 到 1.0 的实时健康分机制。请求失败(如 429/5xx)将显著扣分,使受损账号自动降级;成功请求则逐步回升,实现账号状态的智能自愈。

- 三级智能排序: 调度优先级重构为

订阅等级 > 剩余配额 > 健康分。确保在同等级、同配额情况下,始终优先通过历史表现最稳定的账号。 - 微延迟 (Throttle Delay): 针对极端限流��场景,当所有账号均被封锁且有账号在 2 秒内即将恢复时,系统将自动执行毫秒级挂起等待而非直接报错。极大提升了高并发下的成功率,并增强了会话粘性。

- 全量接口适配: 重构了

TokenManager核心接口,并完成了全量处理器(Claude, Gemini, OpenAI, Audio, Warmup)的同步适配,确保调度层变更对业务层透明。

- [核心修复] 固定账号模式持久化 (PR #1209):

- 问题背景: 之前版本在重启服务后,固定账号模式(Fixed Account Mode)的开关状态会被重置。

- 修复内容: 实现了设置的持久化存储,确保用户偏好在重启后依然生效。

- [核心修复] 速率限制毫秒级解析 (PR #1210):

- 问题背景: 部分上游服务返回的

Retry-After或速率限制头部包含带小数点的毫秒值,导致解析失败。 - 修复内容: 增强了时间解析逻辑,支持兼容浮点数格式的时间字段,提高了对非标准上游的兼容性。

- 问题背景: 部分上游服务返回的

- [功能增强] 深度集成 Gemini 图像生成与多协议支持 (PR #1203):

-

v4.0.3 (2026-01-27):

- [功能增强] 提高请求体限制以支持大体积图片 Payload (PR #1167):

- 将默认请求体大小限制从 2MB 提升至 100MB,解决多图并发传输时的 413 (Payload Too Large) 错误。

- 新增环境变量

ABV_MAX_BODY_SIZE,支持用户根据需求动态调整最大限制。 - 服务启动时自动输出当前生效的 Body Limit 日志,便于排查。

- [核心修复] 解决 Google OAuth 'state' 参数缺失导致的授权失败 (Issue #1168):

- 修复了添加 Google 账号时可能出现的 "Agent execution terminated" 错误。

- 实现了随机

state参�数的生成与回调验证,增强了 OAuth 流程的安全性和兼容性。 - 确保在桌面端和 Web 模式下的授权流程均符合 OAuth 2.0 标准。

- [核心修复] 解决 Docker/Web 模式下代理开关及账号变动需重启生效的问题 (Issue #1166):

- 实现了代理开关状态的持久化存储,确保容器重启后状态保持一致。

- 在账号增删、切换、重排及导入后自动触发 Token 管理器热加载,使变更立即在反代服务中生效。

- 优化了账号切换逻辑,自动清除旧会话绑定,确保请求立即路由到新账号。

- [功能增强] 提高请求体限制以支持大体积图片 Payload (PR #1167):

-

v4.0.2 (2026-01-26):

- [核心修复] 解决开启“访问授权”导致的重复认证与 401 循环 (Fix Issue #1163):

- 修正了后端鉴权中间件逻辑,确保在鉴权关闭模式(Off/Auto)下管理接口不再强制拦截。

- 增强了健康检查路径 (

/api/health) 的免鉴权豁免,避免 UI 加载初期因状态检测失败触发登录。 - 在前端请求层引入了 401 异常频率限制(防抖锁),彻底解决了大批量请求失败导致的 UI 弹窗抖动。

- [核心修复] 解决切换账号后会话无法持久化保存 (Fix Issue #1159):

- 增强了数据库注入逻辑,在切换账号时同步更新身份标识(Email)并清除旧的 UserID 缓存。

- 解决了因 Token 与身份标识不匹配导致客户端无法正确关联或保存新会话的问题。

- [核心修复] Docker/Web 模式下模型映射持久化 (Fix Issue #1149):

- 修复了在 Docker 或 Web 部署模式下,管理员通过 API 修改的模型映射配置(Model Mapping)无法保存到硬盘的问题。

- 确保

admin_update_model_mapping接口正确调用持久化逻辑,配置在重启容器后依然生效。

- [架构优化] MCP 工具支持架构全面升级 (Schema Cleaning & Tool Adapters):

- 约束语义回填 (Constraint Hints):

- 实现了智能约束迁移机制,在删除 Gemini 不支持的约束字段(

minLength,pattern,format等)前,自动将其转化为描述提示。 - 新增

CONSTRAINT_FIELDS常量和move_constraints_to_description函数,确保模型能通过描述理解原始约束。 - 示例:

{"minLength": 5}→{"description": "[Constraint: minLen: 5]"}

- 实现了智能约束迁移机制,在删除 Gemini 不支持的约束字段(

- anyOf/oneOf 智能扁平化增强:

- 重写

extract_best_schema_from_union函数,使用评分机制选择最佳类型(object > array > scalar)。 - 在合并后自动添加

"Accepts: type1 | type2"提示到描述中,保留所有可能类型的信息。 - 新增

get_schema_type_name函数,支持显式类型和结构推断。

- 重写

- 插件化工具适配器层 (Tool Adapter System):

- 创建

ToolAdaptertrait,为不同 MCP 工具提供定制化 Schema 处理能力。 - 实现

PencilAdapter,自动为 Pencil 绘图工具的视觉属性(cornerRadius,strokeWidth)和路径参数添加说明。 - 建立全局适配器注册表,支持通过

clean_json_schema_for_tool函数应用工具特定优化。

- 创建

- 高性能缓存层 (Schema Cache):

- 实现基于 SHA-256 哈希的 Schema 缓存机制,避免重复清洗相同的 Schema。

- 采用 LRU 淘汰策略,最大缓存 1000 条,内存占用 < 10MB。

- 提供

clean_json_schema_cached函数和缓存统计功能,预计性能提升 60%+。

- 影响范围:

- ✅ 显著提升 MCP 工具(如 Pencil)的 Schema 兼容性和模型理解能力

- ✅ 为未来添加更多 MCP 工具(filesystem, database 等)奠定了插件化基础

- ✅ 完全向后兼容,所有 25 项测试通过

- 约束语义回填 (Constraint Hints):

- [安全增强] Web UI 管理后台密码与 API Key 分离 (Fix Issue #1139):

- 独立密码配置: 支持通过

ABV_WEB_PASSWORD或WEB_PASSWORD环境变量设置独立的管理后台登录密码。 - 智能鉴权逻辑:

- 管理接口优先验证独立密码,未设置时自动回退验证

API_KEY(确保向后兼容)。 - AI 代理接口严格仅允许使用

API_KEY进行认证,实现权限隔离。

- 管理接口优先验证独立密码,未设置时自动回退验证

- 配置 UI 支持: 在“仪表盘-服务配置”中新增管理密码编辑项,支持一键找回或修改。

- 日志引导: Headless 模式启动时会清晰打印 API Key 与 Web UI Password 的状态及查看方式。

- 独立密码配置: 支持通过

- [核心修复] 解决开启“访问授权”导致的重复认证与 401 循环 (Fix Issue #1163):

-

v4.0.1 (2026-01-26):

- [UX 优化] 主题与语言切换平滑度:

- 解决了主题和语言切换时的 UI 卡顿问题,将配置持久化逻辑与状态更新解耦。

- 优化了导航栏中的 View Transition API 使用,确保视觉更新不阻塞操作。

- 将窗口背景同步调用改为异步,避免 React 渲染延迟。

- [核心修复] 反代服务启动死锁:

- 修复了启动反代服务时会阻塞状态轮询请求的竞态/死锁问题。

- 引入了原子启动标志和非阻塞状态检查,确保 UI 在服务初始化期间保持响应。

- [UX 优化] 主题与语言切换平滑度:

-

v4.0.0 (2026-01-25):

- [重大架构] 深度迁移至 Tauri v2 (Tauri v2 Migration):

- 全面适配 Tauri v2 核��心 API,包括系统托盘、窗口管理与事件系统。

- 解决了多个异步 Trait 动态派发与生命周期冲突问题,后端性能与稳定性显著提升。

- [部署革新] 原生 Headless Docker 模式 (Native Headless Docker):

- 实现了“纯后端”Docker 镜像,彻底移除了对 VNC、noVNC 或 XVFB 的依赖,大幅降低内存与 CPU 占用。

- 支持直接托管前端静态资源,容器启动后即可通过浏览器远程管理。

- [部署修复] Arch Linux 安装脚本修复 (PR #1108):

- 修复了

deploy/arch/PKGBUILD.template中硬编码data.tar.zst导致的提取失败问题。 - 实现了基于通配符的动态压缩格式识别,确保兼容不同版本的

.deb包。

- 修复了

- [管理升级] 全功能 Web 管理界面 (Web-based Console):

- 重写了管理后台,使所有核心功能(账号管理、API 反代监控、OAuth 授权、模型映射)均可在浏览器端完成。

- 补全了 Web 模式下的 OAuth 回调处理,支持

ABV_PUBLIC_URL自定义,完美适配远程 VPS 或 NAS 部署场景。

- [项目规范化] 结构清理与单元化 (Project Normalization):

- 清理了冗余的

deploy目录及其旧版脚本,项目结构更加现代。 - 规范化 Docker 镜像名称为

antigravity-manager,并整合专属的docker/目录与部署手册。

- 清理了冗余的

- [API 增强] 流量日志与监控优化:

- 优化了流量日志的实时监控体验,补全了 Web 模式下的轮询机制与统计接口。

- 精确化管理 API 路由占位符命名,提升了 API 的调用精确度。

- [用户体验] 监控页面布局与深色模式优化 (PR #1105):

- 布局重构: 优化了流量日志页面的容器布局,采用固定最大宽度与响应式边距,解决了在大屏显示器下的内容过度拉伸问题,视觉体验更加舒适。

- 深色模式一致性: 将日志详情弹窗的配色方案从硬编码的 Slate 色系迁移至 Base 主题色系,确保与全局深色模式风格无缝统一,提升了视觉一致性。

- [用户体验] 自动更新体验优化:

- 智能降级: 修复了当原生更新包未就绪(如 Draft Release)时点击更新无反应的问题。现在系统会自动检测并提示用户,同时优雅降级至浏览器下载模式,确保持续可更新。

- [核心修复] 深度优化 Signature Cache 与 Rewind 检测 (PR #1094):

- 400 错误自愈: 增强了思考块签名的清洗逻辑。系统现在能自动识别因服务器重启导致的“无主签名”,并在发送给上游前主动将其剥离,从根本上杜绝了由此引发了

400 Invalid signature报错。 - Rewind (回退) 检测机制: 升级缓存层,引入消息计数(Message Count)校验。当用户回退对话历史并重新发送时,系统会自动重置签名状态,确保对话流的合法性。

- 全链路适配: 优化了 Claude、Gemini 及 z.ai (Anthropic) 的数据链路,确保消息计数在流式与非流式请求中均能精准传播。

- 400 错误自愈: 增强了思考块签名的清洗逻辑。系统现在能自动识别因服务器重启导致的“无主签名”,并在发送给上游前主动将其剥离,从根本上杜绝了由此引发了

- [OpenAI 鲁棒性增强] 优化重试策略与模型级限流 (PR #1093):

- 鲁棒重试: 强制最小 2 次请求尝试,确保单账号模式下也能有效应对瞬时网络抖动;移除了配额耗尽的硬中断,允许自动轮换账号。

- 模型级限流: 引入模型级限流隔离,避免单个模型限流锁定整个账号,确保账号下其他模型可用。

- 接口修复: 修复了 TokenManager 异步接口的 Email/ID 混用漏洞,确保限流记录准确。

- [系统鲁棒性] 统一重试与退避调度中心 (Unified Retry & Backoff Hub):

- 逻辑归一化: 将散落在各协议处理器中的重试逻辑抽象至

common.rs,实现全局统一调度。 - 强制退避延迟: 彻底修复了原先逻辑中解析不到

Retry-After就立即重试导致封号的问题。现在所有处理器在重试前必须通过共享模块执行物理等待,有效保护 IP 信誉。 - 激进参数调整: 针对 Google/Anthropic 频率限制,将 429 和 503 的初始退避时间显著上调至 5s-10s,大幅降低生产环境风控风险。

- 逻辑归一化: 将散落在各协议处理器中的重试逻辑抽象至

- [CLI 同步优化] 解决 Token 冲突与模型配置清理 (PR #1054):

- 自动冲突解决: 在设置

ANTHROPIC_API_KEY时自动移除冲突的ANTHROPIC_AUTH_TOKEN,解决 Claude CLI 同步报错问题。 - 环境变量清理: 同步时自动移除

ANTHROPIC_MODEL等可能干扰模型输出的环境变量,确保 CLI 使用标准模型。 - 配置健壮性: 优化了 API Key 为空时的处理方式,避免无效配置干扰。

- 自动冲突解决: 在设置

- [核心优化] 用量缩放功能默认关闭与联动机制 (Usage Scaling Default Off):

- 默认关闭: 基于用户反馈,将"启用用量缩放"功能从默认开启改为默认关闭,回归透明模式。

- 联动机制: 建立了缩放与自动压缩 (L1/L2/L3) 的联动关系。只有当用户主动开启缩放时,才同步激活自动压缩逻辑。

- 解决痛点: 修复了用户反馈的"缩放致盲"问题 - 默认模式下客户端能看到真实 Token 用量,在接近 200k 时触发原生

/compact提示,避免死锁。 - 功能定位: 将缩放+压缩重新定义为"激进扩容模式",仅供处理超大型项目时手动开启,提升系统稳定性与可预测性。

- ⚠️ 升级提醒: 从旧版本升级的用户,建议在"设置 → 实验性功能"中手动关闭"启用用量缩放",以获得更稳定透明的体验。

- [协议优化] 全协议自动流式转换 (Auto-Stream Conversion):

- 全链路覆盖: 对 OpenAI (Chat/Legacy/Codex) 和 Gemini 协议实现了强制内部流式化转换。即使客户端请求非流式 (

stream: false),后端也会自动建立流式连接与上游通信,极大提升了连接稳定性和配额利用率。 - 智能聚合: 实现了高性能的流式聚合器,在兼容旧版客户端的同时,还能在后台实时捕获 Thinking 签名,有效解决了非流式请求下签名丢失导致后续工具调用失败的问题。

- 全链路覆盖: 对 OpenAI (Chat/Legacy/Codex) 和 Gemini 协议实现了强制内部流式化转换。即使客户端请求非流式 (

- [核心修复] 错误日志元数据补全 (Log Metadata Fix):

- 问题背景: 之前版本在 429/503 等严重错误(如账号耗尽)发生时,日志记录中遗漏了

mapped_model和account_email字段,导致无法定位出错的具体模型和账号。 - 修复内容: 在 OpenAI 和 Claude 协议的所有错误退出路径(包括 Token 获取失败、转换异常、重试耗尽)中强制注入了元数据 Header。现在即使请求失败,流量日志也能准确显示目标模型和上下文信息,极大提升了排查效率。

- 问题背景: 之前版本在 429/503 等严重错误(如账号耗尽)发生时,日志记录中遗漏了

- [重大架构] 深度迁移至 Tauri v2 (Tauri v2 Migration):

-

v4.0.0 (2026-01-25):

- [核心功能] 后台任务模型可配置 (Background Model Configuration):

- 功能增强: 允许用户自定义“后台任务”(��如标题生成、摘要压缩)使用的模型。不再强制绑定

gemini-2.5-flash。 - UI 更新: 在“模型映射”页面新增了“后台任务模型”配置项,支持从下拉菜单中选择任意可用模型(如

gemini-3-flash)。 - 路由修复: 修复了后台任务可能绕过用户自定义映射的问题。现在

internal-background-task会严格遵循用户的重定向规则。

- 功能增强: 允许用户自定义“后台任务”(��如标题生成、摘要压缩)使用的模型。不再强制绑定

- [重要通告] 上游模型容量预警 (Capacity Warning):

- 容量不足: 接获大量反馈,上游 Google 的

gemini-2.5-flash和gemini-2.5-flash-lite模型当前正处于极度容量受限状态 (Rate Limited / Capacity Exhausted)。 - 建议操作: 为保证服务可用性,建议用户暂时在“自定义映射”中将上述两个模型重定向至其他模型(如

gemini-3-flash或gemini-3-pro-high),直到上游恢复。

- 容量不足: 接获大量反馈,上游 Google 的

- [核心修复] Windows 启动参数支持 (PR #973):

- 问题修复: 修复了 Windows 平台下启动参数(如内网穿透配置等)无法正确解析生效的问题。感谢 @Mag1cFall 的贡献。

- [核心修复] Claude 签名校验增强 (PR #1009):

- 功能优化: 增强了 Claude 模型的签名校验逻辑,修复了在长对话或复杂工具调用场景下可能出现的 400 错误。

- 兼容性提升: 引入最小签名长度校验,并对合法长度的未知签名采取信任策略,大幅提升了 JSON 工具调用的稳定性。

- [国际化] 越南语翻译优化 (PR #1017):

- 翻译精简: 对关于页面等区域的越南语翻译进行了精简与标点优化。

- [国际化] 土耳其语托盘翻�译增强 (PR #1023):

- 功能优化: 为系统托盘菜单增加了完整的土耳其语翻译支持,提升了土耳其语用户的操作体验。

- [功能增强] 多语言支持与 I18n 设置 (PR #1029):

- 新增语言支持: 增加了葡萄牙语、日语、越南语、土耳其语、俄语等多国语言的更完整支持。

- I18n 设置面板: 在设置页面新增了语言选择器,支持即时切换应用显示语言。

- [国际化] 韩语支持与界面优化 (New):

- 韩语集成: 新增了完整的韩语 (

ko) 翻译支持,现在可以在设置中选择韩语界面。 - UI 交互升级: 重构了顶部导航栏的语言切换器,由原来的单次点击循环切换升级为更直观的下拉菜单,展示语言缩写与全称,提升了多语言环境下的操作体验。

- 韩语集成: 新增了完整的韩语 (

- [核心功能] 后台任务模型可配置 (Background Model Configuration):

-

v3.3.49 (2026-01-22):

-

[核心修复] Thinking 后中断与 0 Token 防御 (Fix Thinking Interruption):

- 问题背景: 针对 Gemini 等模型在输出 Thinking 内容后流意外中断,导致 Claude 客户端收到 0 Token 响应并报错死锁的问题。

- 防御机制:

- 状态追踪: 实时监测流式响应中是否“只想未说”(已发送 Thinking 但未发送 Content)。

- 自动兜底: 当检测到此类中断时,系统会自动闭合 Thinking 块,注入系统提示信息,并模拟正常的 Usage 数据,确保客户端能优雅结束会话。

-

[核心修复] 移除 Flash Lite 模型以修复 429 错误 (Fix 429 Errors):

- 问题背景: 今日监测发现

gemini-2.5-flash-lite频繁出现 429 错误,具体原因为 上游 Google 容器容量耗尽 (MODEL_CAPACITY_EXHAUSTED),而非通常的账号配额不足。 - 紧急修复: 将所有系统内部默认的

gemini-2.5-flash-lite调用(如后台标题生成、L3 摘要压缩)及预设映射全部替换为更稳定的gemini-2.5-flash。 - 用户提醒: 如果您在“自定义映射”或“预设”中手动使用了

gemini-2.5-flash-lite,请务必修改为其他模型,否则可能会持续遇到 429 错误。

- 问题背景: 今日监测发现

-

[性能优化] 设置项即时生效 (Fix PR #949):

- 即时生效: 修复了语言切换需要手动点击保存的问题。现在修改语言设置会立即应用到整个 UI。

-

[代码清理] 后端架构重构与优化 (PR #950):

- 架构精简: 深度重构了代理层的 Mapper 和 Handler 逻辑,移除了冗余模块(如

openai/collector.rs),显著提升了代码的可维护性。 - 稳定性增强: 优化了 OpenAI 与 Claude 协议的转换链路,统一了图片配置解析逻辑,并加固了上下文管理器的健壮性。

- 架构精简: 深度重构了代理层的 Mapper 和 Handler 逻辑,移除了冗余模块(如

-

[核心修复] 设置项同步策略更新:

- 状态同步: 修正了主题切换的即时应用逻辑,并解决了

App.tsx与Settings.tsx之间的状态冲突,确保配置加载过程中的 UI 一致性。

- 状态同步: 修正了主题切换的即时应用逻辑,并解决了

-

[核心优化] 上下文压缩与 Token 节省:

- 由于 Claude CLI 在恢复历史记录时会发送大量上下文,现已将压缩阈值改为可配置并降低默认值。

- L3 摘要重置阈值由 90% 降至 70%,在 token 堆积过多前提前进行压缩节省额度。

- 前端 UI 增强:在实验性设置中新增 L1/L2/L3 压缩阈值滑块,支持动态自定义。

-

[功能增强] API 监控看板功能升级 (PR #951):

- 账号筛选: 新增按账号筛选流量日志的功能,支持在大流量环境下精准追踪特定账号的调用情况。

- 详情深度增强: 监控详情页现在可以完整显示请求协议(OpenAI/Anthropic/Gemini)、使用账号、映射后的物理模型等关键元数据。

- UI 与国际化: 优化了监控详情的布局,并补全了 8 种语言的相关翻译。

-

[JSON Schema 优化] 递归收集 $defs 并完善回退处理 (PR #953):

- 递归收集: 添加了

collect_all_defs()以递归方式从所有模式层级收集$defs/definitions,解决了嵌套定义丢失的问题。 - 引用平坦化: 始终运行

flatten_refs()以捕获并处理孤立的$ref字段。 - 回退机制: 为未解析的

$ref添加了回退逻辑,将其转换为带有描述性提示的字符串类型。 - 稳定性增强: 新增了针对嵌套定义和未解析引用的测试用例,确保 Schema 处理的健壮性。

- 递归收集: 添加了

-

[核心修复] 账号索引保护 (Fix Issue #929):

- 安全加固: 移除了加载失败时的自动删除逻辑,防止在升级或环境异常时意外丢失账号索引,确保用户数据安全。

-

[核心优化] 路由器与模型映射深度优化 (PR #954):

- 路由器确定性优先级: 修复了路由器在处理多通配符模式时的不确定性问题,实现了基于模式长度和复杂度的确定性匹配优先级。

-

[稳定性增强] OAuth 回调与解析优化 (Fix #931, #850, #778):

- 鲁棒解析: 优化了本地回调服务器的 URL 解析逻辑,不再依赖单一分割符,提升了不同浏览器下的兼容性。

- 调试增强: 增加了原始请求 (Raw Request) 记录功能,当授权失败时可直接在日志中查看原始数据,方便定位网络拦截问题。

-

[网络优化] OAuth 通信质量提升 (Issue #948, #887):

- 延时保障: 将授权请求超时时间延长至 60 秒,大幅提升了在代理环境下的 Token 交换成功率。

- 错误指引: 针对 Google API 连接超时或重置的情况,新增了明确的中文代理设置建议,降低排查门槛。

-

[体验优化] 上游代理配置校验与提示增强 (Contributed by @zhiqianzheng):

- 配置校验: 当用户启用上游代理但未填写代理地址时,保存操作将被阻止并显示明确的错误提示,避免无效配置导致的连接失败。

- 重启提醒: 成功保存代理配置后,系统会提示用户需要重启应用才能使配置生效,降低用户排查成本。

- 多语言支持: 新增简体中文、繁体中文、英文、日语的相关翻译。

-

-

v3.3.48 (2026-01-21):

- [核心修复] Windows 控制台闪烁问题 (Fix PR #933):

- 问题背景: Windows 平台在启动或执行后台命令时,偶尔会弹出短暂的 CMD 窗口,影响用户体验。

- 修复内容: 在

cloudflared进程创建逻辑中添加CREATE_NO_WINDOW标志,确保所有后台进程静默运行。 - 影响范围: 解决了 Windows 用户在启动应用或 CLI 交互时的窗口闪烁问题。

- [核心修复] Windows 控制台闪烁问题 (Fix PR #933):

-

v3.3.47 (2026-01-21):

- [核心修复] 图片生成 API 参数映射增强 (Fix Issue #911):

- 功能: 支持从 OpenAI 参数 (

size,quality) 解析配置,支持动态宽高比计算,quality: hd自动映射为 4K 分辨率。 - 影响: 显著提升 Images API 兼容性,OpenAI 与 Claude 协议均受支持。

- 功能: 支持从 OpenAI 参数 (

- [功能增强] Cloudflared 内网穿透支持 (PR #923):

- 核心功能: 集成

cloudflared隧道支持,允许用户在无公网 IP 或处于复杂内网环境下,通过 Cloudflare 隧道一键发布 API 服务。 - 易用性优化: 前端新增 Cloudflared 配置界面,支持状态监控、日志查看及一键开关隧道。

- 国际化补全: 补全了繁体中文、英文、日文、韩文、越南语、土耳其语、俄语等 8 国语言的 Cloudflared 相关翻译。

- 核心功能: 集成

- [核心修复] 解决 Git 合并冲突导致的启动失败:

- 修复内容: 解决了

src-tauri/src/proxy/handlers/claude.rs中因多进程并行合并产生的<<<<<<< HEAD冲突标记。 - 影响范围: 恢复了后端服务的编译能力,修复了应用启动即崩溃的问题。

- 修复内容: 解决了

- [核心优化] 三层渐进式上下文压缩 (3-Layer Progressive Context PCC):

- 背景: 长对话场景下频繁触发 "Prompt is too long" 错误,手动

/compact操作繁琐,且现有压缩策略会破坏 LLM 的 KV Cache,导致成本飙升 - 解决方案 - 多层渐进式压缩策略:

- Layer 1 (60% 压力): 工具消息智能裁剪

- 删除旧的工具调用/结果消息,保留最近 5 轮交互

- 完全不破坏 KV Cache(只删除消息,不修改内容)

- 压缩率:60-90%

- Layer 2 (75% 压力): Thinking 内容压缩 + 签名保留

- 压缩

assistant消息中的 Thinking 块文本内容(替换为 "...") - 完整保留

signature字段,解决 Issue #902(签名丢失导致 400 错误) - 保护最近 4 条消息不被压缩

- 压缩率:70-95%

- 压缩

- Layer 3 (90% 压力): Fork 会话 + XML 摘要

- 使用

gemini-2.5-flash-lite生成 8 节 XML 结构化摘要(成本极低) - 提取并保留最后一个有效 Thinking 签名

- 创建新的消息序列:

[User: XML摘要] + [Assistant: 确认] + [用户最新消息] - 完全不破坏 Prompt Cache(前缀稳定,只追加)

- 压缩率:86-97%

- 使用

- Layer 1 (60% 压力): 工具消息智能裁剪

- 技术实现:

- 新增模块:

context_manager.rs中实现 Token 估算、工具裁剪、Thinking 压缩、签名提取等核心功能 - 辅助函数:

call_gemini_sync()- 可复用的同步上游调用函数 - XML 摘要模板: 8 节结构化摘要(目标、技术栈、文件状态、代码变更、调试历史、计划、偏好、签名)

- 渐进式触发: 按压力等级自动触发,每次压缩后重新估算 Token 用量

- 新增模块:

- 成本优化:

- Layer 1: 完全无成本(不破坏缓存)

- Layer 2: 低成本(仅破坏部分缓存)

- Layer 3: 极低成本(摘要生成使用 flash-lite,新会话完全缓存友好)

- 综合节省: 86-97% Token 成本,同时保持签名链完整性

- 用户体验:

- 自动化:无需手动

/compact,系统自动处理 - 透明化:详细日志记录每层压缩的触发和效果

- 容错性:Layer 3 失败时返回友好错误提示

- 自动化:无需手动

- 影响范围: 解决长对话场景下的上下文管理问题,显著降低 API 成本,确保工具调用链完整性

- 背景: 长对话场景下频繁触发 "Prompt is too long" 错误,手动

- [核心优化] 上下文估算与缩放算法增强 (PR #925):

- 背景: 在 Claude Code 等长对话场景下,固定的 Token 估算算法(3.5 字符/token)在中英文混排时误差极大,导致三层压缩逻辑无法及时触发,最终仍会报 "Prompt is too long" 错误

- 解决方案 - 动态校准 + 多语言感知:

- 多语言感知估算:

- ASCII/英文: 约为 4 字符/Token(针对代码和英文文档优化)

- Unicode/CJK (中日韩): 约为 1.5 字符/Token(针对 Gemini/Claude 分词特点)

- 安全余量: 在计算结果基础上额外增加 15% 的安全冗余

- 动态校准器 (

estimation_calibrator.rs):- 自学习机制: 记录每次请求的"估算 Token 数"与 Google API 返回的"实际 Token 数"

- 校准因子: 使用指数移动平均 (EMA, 60% 旧比例 + 40% 新比例) 维护校准系数

- 保守初始化: 初始校准系数为 2.0,确保系统运行初期极其保守地触发压缩

- 自动收敛: 根据实际数据自动修正,使估算值越来越接近真实值

- 整合三层压缩框架:

- 在所有估算环节(初始估算、Layer 1/2/3 后重新估算)使用校准后的 Token 数

- 每层压缩后记录详细的校准因子日志,便于调试和监控

- 多语言感知估算:

- 技术实现:

- 新增模块:

estimation_calibrator.rs- 全局单例校准器,线程安全 - 修改文件:

claude.rs,streaming.rs,context_manager.rs - 校准数据流: 流式响应收集器 → 提取真实 Token 数 → 更新校准器 → 下次请求使用新系数

- 新增模块:

- 用户体验:

- 透明化: 日志中显示原始估算值、校准后估算值、校准因子,便于理解系统行为

- 自适应: 系统会根据用户的实际使用模式(中英文比例、代码量等)自动调整

- 精准触发: 压缩逻辑基于更准确的估算值,大幅降低"漏判"和"误判"概率

- 影响范围: 显著提升上下文管理的精准度,解决 Issue #902 和 #867 中反馈的自动压缩失效问题,确保长对话稳定性

- [关键修复] Thinking 签名恢复逻辑优化:

- 背景: 在重试场景下,签名检查逻辑未检查 Session Cache,导致错误禁用 Thinking 模式,产生 0 token 请求和响应失败

- 问题表现:

- 重试时显示 "No valid signature found for function calls. Disabling thinking"

- 流量日志显示

I: 0, O: 0(实际请求成功但 Token 未记录) - 客户端可能无法接收到响应内容

- 修复内容:

- 扩展签名检查范围:

has_valid_signature_for_function_calls()现在检查 Session Cache - 检查优先级: Global Store → Session Cache (新增) → Message History

- 详细日志: 添加签名来源追踪日志,便于调试

- 扩展签名检查范围:

- 技术实现:

- 修改

request.rs中的签名验证逻辑 - 新增

session_id参数传递到签名检查函数 - 添加

[Signature-Check]系列日志用于追踪签名恢复过程

- 修改

- 影响: 解决重试场景下的 Thinking 模式降级问题,确保 Token 统计准确性,提升长会话稳定性

- [核心修复] 通用参数对齐引擎 (Universal Parameter Alignment Engine):

- 背景: 解决 Gemini API 在调用工具(Tool Use)时因参数类型不匹配产生的

400 Bad Request错误。 - 修复内容:

- 实现参数对齐引擎: 在

json_schema.rs中实现fix_tool_call_args,基于 JSON Schema 自动将字符串类型的数字/布尔值转换为目标类型,并处理非法字段。 - 多协议重构: 同步重构了 OpenAI 和 Claude 协议层,移除了硬编码的工具参数修正逻辑,改用统一的对齐引擎。

- 实现参数对齐引擎: 在

- 解决问题: 修复了

local_shell_call、apply_patch等工具在多级反代或特定客户端下参数被错误格式化为字符串导致的异常。 - 影响: 显著提升了工具调用的稳定性,减少了上游 API 的 400 错误。

- 背景: 解决 Gemini API 在调用工具(Tool Use)时因参数类型不匹配产生的

- [功能增强] 画图模型配额保护支持 (Fix Issue #912):

- 问题背景: 用户反馈画图模型(G3 Image)没有配额保护功能,导致配额耗尽的账号仍被用于画图请求

- 修复内容:

- 后端配置: 在

config.rs的default_monitored_models()中添加gemini-3-pro-image,与智能预热和配额关注列表保持一致 - 前端 UI: 在

QuotaProtection.tsx中添加画图模型选项,调整布局为一行4个模型(与智能预热保持一致)

- 后端配置: 在

- 影响范围:

- ✅ 向后兼容:已有配置不受影响,新用户或重置配置后会自动包含画图模型

- ✅ 完整保护:现在所有4个核心模型(Gemini 3 Flash、Gemini 3 Pro High、Claude 4.5 Sonnet、Gemini 3 Pro Image)都受配额保护监控

- ✅ 自动触发:当画图模型配额低于阈值时,账号会自动加入保护列表,避免继续消耗

- [传输层优化] 流式响应防缓冲优化 (Streaming Response Anti-Buffering):

- 背景: 在 Nginx 等反向代理后部署时,流式响应可能被代理缓冲,导致客户端延迟增加

- 修复内容:

- 添加 X-Accel-Buffering Header: 在所有流式响应中注入

X-Accel-Buffering: no头部 - 多协议覆盖: Claude (

/v1/messages)、OpenAI (/v1/chat/completions) 和 Gemini 原生协议全部支持

- 添加 X-Accel-Buffering Header: 在所有流式响应中注入

- 技术细节:

- 修改文件:

claude.rs:L877,openai.rs:L314,gemini.rs:L240 - 该 Header 告诉 Nginx 等反向代理不要缓冲流式响应,直接透传给客户端

- 修改文件:

- 影响: 显著降低反向代理场景下的流式响应延迟,提升用户体验

- [错误恢复增强] 多协议签名错误自愈提示词 (Multi-Protocol Signature Error Recovery):

- 背景: 当 Thinking 模式下出现签名错误时,仅剔除签名可能导致模型生成空响应或简单的 "OK"

- 修复内容:

- Claude 协议增强: 在现有签名错误重试逻辑中追加修复提示词,引导模型重新生成完整响应

- OpenAI 协议实现: 新增 400 签名错误检测和修复提示词注入逻辑

- Gemini 协议实现: 新增 400 签名��错误检测和修复提示词注入逻辑

- 修复提示词:

[System Recovery] Your previous output contained an invalid signature. Please regenerate the response without the corrupted signature block. - 技术细节:

- Claude:

claude.rs:L1012-1030- 增强现有逻辑,支持 String 和 Array 消息格式 - OpenAI:

openai.rs:L391-427- 完整实现,使用OpenAIContentBlock::Text类型 - Gemini:

gemini.rs:L17, L299-329- 修改函数签名支持可变 body,注入修复提示词

- Claude:

- 影响:

- ✅ 提升错误恢复成功率:模型收到明确指令,避免生成无意义响应

- ✅ 多协议一致性:所有 3 个协议具有相同的错误恢复能力

- ✅ 用户体验改善:减少因签名错误导致的对话中断

- [核心修复] 图片生成 API 参数映射增强 (Fix Issue #911):

-

v3.3.46 (2026-01-20):

- [功能增强] Token 使用统计 (Token Stats) 深度优化与国际化标准化 (PR #892):

- UI/UX 统一: 实现了自定义 Tooltip 组件,统一了面积图、柱状图和饼图的悬浮提示样式,增强了深色模式下的对比度与可读性。

- 视觉细节磨砂: 优化了图表光标和网格线,移除冗余的 hover 高亮,使图表界面更加清爽专业。

- 自适应布局: 改进了图表容器的 Flex 布局,确保在不同窗口尺寸下均能填充满垂直空间,消除了图表下方的留白。

- 分账号趋势统计: 新增了“按账号查看”模式,支持通过饼图和趋势图直观分析各账号的 Token 消耗占比与活跃度。

- 国际化 (i18n) 标准化: 解决了

ja.json、zh-TW.json、vi.json、ru.json、tr.json等��多国语言文件中的键值重复警告。补全了account_trend、by_model等缺失翻译,确保 8 种语言下的 UI 展现高度一致。

- [核心修复] 移除 [DONE] 停止序列以防止输出截断 (PR #889):

- 问题背景:

[DONE]是 SSE (Server-Sent Events) 协议的标准结束标记,在代码和文档中经常出现。将其作为stopSequence会导致模型在解释 SSE 相关内容时输出被意外截断。 - 修复内容: 从 Gemini 请求的

stopSequences数组中移除了"[DONE]"标记。 - 技术说明:

- Gemini 流的真正结束由

finishReason字段控制,无需依赖stopSequence - SSE 层面的

"data: [DONE]"已在mod.rs中单独处理

- Gemini 流的真正结束由

- 影响范围: 解决了模型在生成包含 SSE 协议说明、代码示例等内容时被提前终止的问题 (Issue #888)。

- 问题背景:

- [部署优化] Docker 镜像构建双模适配 (Default/China Mode):

- 双模架构: 引入

ARG USE_CHINA_MIRROR构建参数。默认模式保持原汁原味的 Debian 官方源(适合海外/云构建);开启后自动切换为清华大学 (TUNA) 镜像源(适合国内环境)。 - 灵活性大幅提升: 解决了硬编码国内源导致海外构建缓慢的问题,同时保留了国内用户的加速体验。

- 双模架构: 引入

- [稳定性修复] VNC 与容器启动逻辑加固 (PR #881):

- 僵尸进程清理: 优化了

start.sh中的 cleanup 逻辑,改用pkill精准查杀 Xtigervnc 和 websockify 进程,并清理/tmp/.X11-unix锁文件,解决了重启后 VNC 无法连接的各种边缘情况。 - �健康检查升级: 将 Healthcheck 检查项扩展到 websockify 和主程序,确保容器状态更真实地反映服务可用性。

- 重大修复: 修复了 OpenAI 协议请求返回 404 的问题,并解决了 Codex (

/v1/responses) 接收复杂对象数组input或apply_patch等自定义工具(缺失 Schema)时导致上游返回 400 (INVALID_ARGUMENT) 的兼容性缺陷。 - 思维模型优化: 解决了 Claude 3.7 Thinking 模型在历史消息缺失思维链时强制报错的问题,实现了智能协议降级与占位块注入。

- 协议补全: 补全了 OpenAI Legacy 接口的 Token 统计响应与 Header 注入,支持

input_text类型内容块,并将developer角色适配为系统指令。 - requestId 统一: 统一所有 OpenAI 路径下的

requestId前缀为agent-,解决部分客户端的 ID 识别问题。

- 僵尸进程清理: 优化了

- [核心修复] JSON Schema 数组递归清理修复 (解决 Gemini API 400 错误):

- 问题背景: Gemini API 不支持

propertyNames、const等 JSON Schema 字段。虽然已有白名单过滤逻辑,但由于clean_json_schema_recursive函数缺少对Value::Array类型的递归处理,导致嵌套在anyOf、oneOf或items数组内部的非法字段无法被清除,触发Invalid JSON payload received. Unknown name "propertyNames"/"const"错误。 - 修复内容:

- 增加 anyOf/oneOf 合并前的递归清洗: 在合并

anyOf/oneOf分支之前,先递归清洗每个分支内部的内容,确保合并的分支已被清理,防止非法字段在合并过程中逃逸。 - 增加通用数组递归处理分支: 为

match语句增加Value::Array分支,确保所有数组类型的值(包括items、enum等)都会被递归清理,覆盖所有可能包含 Schema 定义的数组字段。

- 增加 anyOf/oneOf 合并前的递归清洗: 在合并

- 测试验证: 新增 3 个测试用例验证修复效果,所有 14 个测试全部通过,无回归。

- 影响范围: 解决了复杂工具定义(如 MCP 工具)中嵌套数组结构导致的 400 错误,确保 Gemini API 调用 100% 兼容。

- 问题背景: Gemini API 不支持

- [功能增强] Token 使用统计 (Token Stats) 深度优化与国际化标准化 (PR #892):

-

v3.3.45 (2026-01-19):

- [核心功能] 解决 Claude/Gemini SSE 中断与 0-token 响应问题 (Issue #859):

- 增强型预读 (Peek) 逻辑: 在向客户端发送 200 OK 响应前,代理现在会循环预读并跳过所有心跳包(SSE ping)及空数据块,确认收到有效业务内容后再建立连接。

- 智能重试触发: 若在预读阶段检测到空响应、超时(60s)或流异常中断,系统将自动触发账号轮换和重试机制,解决了长延迟模型下的静默失败。

- 协议一致性增强: 为 Gemini 协议补齐了缺失的预读逻辑;同时将 Claude 心跳间隔优化为 30s,减少了生成长文本时的连接干扰。

- [核心功能] 固定账号模式集成 (PR #842):

- 后端增强: 在代理核心中引入了

preferred_account_id支持,允许通过 API 或 UI 强制锁定特定账号进行请求调度。 - UI 交互更新: 在 API 反代页面新增“固定账号”切换与账号选择器,支持实时锁定当前会话的出口账号。

- 调度优化: 在“固定账号模式”下优先级高于传统轮询,确保特定业务场景下的会话连续性。

- 后端增强: 在代理核心中引入了

- [国际化] 全语言翻译补全与清理:

- 8 语言覆盖: 补全了中、英、繁中、日、土、越、葡、俄等 8 种语言中关于“固定账号模式”的所有 i18n 翻译项。

- 冗余清理: 修复了

ja.json和vi.json中由于历史 PR 累积导致的重复键(Duplicate Keys)警告,提升了翻译规范性。 - 标点同步: 统一清除了各语言翻译中误用的全角标点,确保 UI 展示的一致性。

- [核心功能] 客户端热更新与 Token 统计系统 (PR #846 by @lengjingxu):

- 热更新 (Native Updater): 集成 Tauri v2 原生更新插件,支持自动检测、下载、安装及重启,实现客户端无感升级。

- Token 消费可视化: 新增基于 SQLite 实现的 Token 统计持久化模块,支持按小时/日/周维度查看总消耗及各账号占比。

- UI/UX 增强: 优化了图表悬浮提示 (Tooltip) 在深色模式下的对比度,隐藏了冗余的 hover 高亮;补全了 8 语言完整翻译并修复了硬编码图例。

- 集成修复: 在本地合并期间修复了 PR 原始代码中缺失插件配置导致的启动崩溃故障。

- [系统加速] 启用清华大学 (TUNA) 镜像源: 优化了 Dockerfile 构建流程,大幅提升国内环境下的插件安装速度。

- [部署优化] 官方 Docker 与 noVNC 支持 (PR #851):

- 全功能容器化: 为 headless 环境提供完整的 Docker 部署方案,内置 Openbox 桌面环境。

- Web VNC 集成: 集成 noVNC,支持通过浏览器直接访问图形界面进行 OAuth 授权(内置 Firefox ESR)。

- 自愈启动流: 优化了

start.sh启动逻辑,支持自动清理 X11 锁文件及服务崩溃自动退出,提升生产��环境稳定性。 - 多语言适配: 内置 CJK 字体,确保 Docker 环境下中文字符正常显示。

- 资源限制优化: 统一设置

shm_size: 2gb,解决容器内浏览器及图形界面崩溃问题。

- [核心功能] 修复账号切换时的设备指纹同步问题:

- 路径探测改进: 优化了

storage.json的探测时机,确保在进程关闭前准确获取路径,兼容自定义数据目录。 - 自动隔离生成: 针对未绑定指纹的账号,在切换时会自动生成并绑定唯一的设备标识,实现账号间的指纹隔离。

- 路径探测改进: 优化了

- [UI 修复] 修复账号管理页条数显示不准确问题 (Issue #754):

- 逻辑修正: 强制分页条数默认最低为 10 条,解决了小窗口下自动变为 5 条或 9 条的不直觉体验。

- 持久化增强: 实现了分页大小的

localStorage持久化,用户手动选择的条数将永久锁定并覆盖自动模式。 - UI 一致性: 确保右下角分页选项与列表实际展示条数始终保持一致。

- [核心功能] 解决 Claude/Gemini SSE 中断与 0-token 响应问题 (Issue #859):

-

v3.3.44 (2026-01-19):

- [核心稳定性] 动态思维剥离 (Dynamic Thinking Stripping) - 解决 Prompt 过长与签名错误:

- 问题背景: 在 Deep Thinking 模式下,长对话会导致两类致命错误:

Prompt is too long: 历史 Thinking Block 累积导致 Token 超限Invalid signature: 代理重启后内存签名缓存丢失,旧签名被 Google 拒收

- 解决方案 - Context Purification (上下文净化):

- 新增

ContextManager模块: 实现 Token 估算与历史清洗逻辑 - 分级清洗策略:

Soft(60%+ 压力): 保留最近 2 轮 Thinking,剥离更早历史Aggressive(90%+ 压力): 移除所有历史 Thinking Block

- 差异化限额: Flash 模型 (1M) 与 Pro 模型 (2M) 采用不同触发阈值

- 签名同步清除: 清洗 Thinking 时自动移除

thought_signature,避免签名校验失败

- 新增

- 透明度增强: 响应头新增

X-Context-Purified: true标识,便于调试 - 性能优化: 基于字符数的轻量级 Token 估算,对请求延迟影响 \u003c 5ms

- 影响范围: 解决 Deep Thinking 模式下的两大顽疾,释放 40%-60% Context 空间,确保长对话稳定性

- 问题背景: 在 Deep Thinking 模式下,长对话会导致两类致命错误:

- [核心稳定性] 动态思维剥离 (Dynamic Thinking Stripping) - 解决 Prompt 过长与签名错误:

-

v3.3.43 (2026-01-18):

- [国际化] 设备指纹对话框全量本地化 (PR #825, 感谢 @IamAshrafee):

- 解决了设备指纹(Device Fingerprint)对话框中残留的硬编码中文字符串问题。

- 补全了英、繁、日等 8 种语言的翻译骨架,提升全球化体验。

- [日语优化] 日语翻译补全与术语修正 (PR #822, 感谢 @Koshikai):

- 补全了 50 多个缺失的翻译键,覆盖配额保护、HTTP API、更新检查等核心设置。

- 优化了技术术语,使日语表达更自然(例如:

pro_low译为“低消費”)。

- [翻译修复] 越南语拼写错误修正 (PR #798, 感谢 @vietnhatthai):

- 修复了越南语设置中

refresh_msg的拼写错误(hiện đài->hiện tại)。

- 修复了越南语设置中

- [兼容性增强] 新增 Google API Key 原生支持 (PR #831):

- 支持

x-goog-api-key请求头:- 认证中间件现在支持识别

x-goog-api-key头部。 - 提高了与 Google 官方 SDK 及第三方 Google 风格客户端的兼容性,无需再手动修改 Header 为

x-api-key。

- 认证中间件现在支持识别

- 支持

- [国际化] 设备指纹对话框全量本地化 (PR #825, 感谢 @IamAshrafee):

-

v3.3.42 (2026-01-18):

- [流量日志增强] 协议自动识别与流式响应整合 (PR #814):

- 协议标签分类: 流量日志列表现在可以根据 URI 自动识别并标注协议类型(OpenAI 绿色、Anthropic 橙色、Gemini 蓝色),使请求来源一目了然。

- 流式数据全整合: 解决了流式响应在日志中仅显示

[Stream Data]的问题。现在会自动拦截并聚合流式数据包,将分散的delta片段还原为完整的回复内容和“思考”过程,大幅提升调试效率。 - 多语言适配: 补全了流量日志相关功能在 8 种语言环境下的 i18n 翻译。

- [重大修复] Gemini JSON Schema 清洗策略深度重构 (Issue #815):

- 解决属性丢失问题: 实现了“最佳分支合并”逻辑。在处理工具定义的

anyOf/oneOf结构时,会自动识别并提取内容最丰富的分支属性向上合并,解决了模型报错malformed function call的顽疾。 - 稳健的白名单机制: 采用针对 Gemini API 的严格白名单过滤策略,剔除不支持的校验字段,确保 API 调用 100% 兼容(从根本上杜绝 400 错误)。

- 约束信息迁移 (Description Hints): 在移除

minLength,pattern,format等字段前,自动将其转为文字描述追加到description中,确保模型依然能感知参数约束。 - Schema 上下文检测锁: 新增安全检查逻辑,确保清洗器仅在处理真正的 Schema 时执行。通过“精准锁”保护了

request.rs中的工具调用结构,确保历史修复逻辑(如布尔值转换、Shell 数组转换)在重构后依然稳如磐石。

- 解决属性丢失问题: 实现了“最佳分支合并”逻辑。在处理工具定义的

- [流量日志增强] 协议自动识别与流式响应整合 (PR #814):

-

v3.3.41 (2026-01-18):

- Claude 协议核心兼容性修复 (Issue #813):

- 连续 User 消息合并: 实现了

merge_consecutive_messages逻辑,在请求进入 Proxy 时自动合并具有相同角色的连续消息流。解决了因 Spec/Plan 模式切换导致的角色交替违规产生的 400 Bad Request 错误。 - EnterPlanMode 协议对齐: 针对 Claude Code 的

EnterPlanMode工具调用,强制清空冗余参数,确保完全符合官方协议,解决了激活 Plan Mode 时的指令集校验失败问题。

- 连续 User 消息合并: 实现了

- 代理鲁棒性增强:

- 增强了工具调用链的自愈能力。当模型因幻觉产生错误路径尝试时,Proxy 现能提供标准的错误反馈引导模型转向正确路径。

- Claude 协议核心兼容性修复 (Issue #813):

-

v3.3.40 (2026-01-18):

- API 400 错误深度修复 (Grep/Thinking 稳定性改进):

- 修复流式块顺序违规: 解决了 "Found 'text' instead of 'thinking'" 400 错误。修正了

streaming.rs中在文字块后非法追加思维块的逻辑,改由缓存机制实现静默同步。 - 思维签名自愈增强: 在

claude.rs中扩展了 400 错误捕获关键词,覆盖了签名失效、顺序违规和协议不匹配场景。一旦触发,代理会自动执行消息降级并快速重试,实现用户无感知的异常自愈。 - 搜索工具参数深度对齐: 修正了

Grep和Glob工具的参数映射逻辑,将query准确映射为path(Claude Code Schema),并支持默认注入执行路径.。 - 工具名重映射策略优化: 改进了重命名逻辑,仅针对

search等模型幻觉进行修正,避免破坏原始工具调用签名。 - 签名缺失自动补完: 针对 LS、Bash、TodoWrite 等工具调用缺失

thought_signature的情况,自动注入通用校验占位符,确保协议链路畅通。

- 修复流式块顺序违规: 解决了 "Found 'text' instead of 'thinking'" 400 错误。修正了

- 架构健壮性优化:

- 增强了全局递归清理函数

clean_cache_control_from_messages,确保cache_control不会干扰 Vertex AI/Anthropic 严格模式。 - 完善了错误日志系统,建立了详细的场景对照表并记录于 docs/client_test_examples.md。

- 增强了全局递归清理函数

- API 400 错误深度修复 (Grep/Thinking 稳定性改进):

-

v3.3.39 (2026-01-17):

- 代理深度优化 (Gemini 稳定性增强):

- Schema 净化器升级:支持

allOf合并、智能联合类型选择、Nullable 自动过滤及空对象参数补全,解决复杂工具定义导致的 400 错误。 - 搜索工具自愈:实现

Search到grep的自动重映射,并引入 Glob-to-Include 迁移(自动将**/*.rs等 Glob 模式移至包含参数),解决 Claude CodeError searching files报错。 - 参数别名补全:统一

search_code_definitions等相关工具的参数映射逻辑,并强制执行布尔值类型转换。 - Shell 调用加固:强制

local_shell_call的command参数返回数组,增强与 Google API 的兼容性。 - 动态 Token 约束:自动根据

thinking_budget调整maxOutputTokens,确保满足 API 强�约束;精简停止序列 (Stop Sequences) 以提升流式输出质量。

- Schema 净化器升级:支持

- Thinking 模式稳定性大幅提升:

- 引入跨模型家族签名校验,自动识别并降级不兼容的思维链签名,防止 400 Bad Request 错误。

- 增强“会话自愈 (Session Healing)”逻辑,支持自动补全被中断的工具循环,确保满足 Google/Vertex AI 的严苛结构要求。

- 高可用性增强:

- 优化自动端点降级 (Endpoint Fallback) 逻辑,在 429 或 5xx 错误时更平滑地切换至备用 API 端点。

- 修复 macOS "Too many open files" 错误 (Issue #784):

- 引入全局共享 HTTP 客户端连接池,大幅减少 Socket 句柄占用。

- 针对 macOS 系统自动提升文件描述符限制 (RLIMIT_NOFILE) 至 4096,增强高并发稳定性。

- 代理深度优化 (Gemini 稳定性增强):

-

v3.3.38 (2026-01-17):

- CLI 同步增强与探测修复 (Fix CLI-Sync Detection):

- 探测路径扩展: 优化了二进制检测逻辑。新增对

~/.local/bin(curl 安装常用路径)、~/.npm-global/bin以及~/bin的扫描。 - nvm 多版本支持: 引入对

nvm目录的深度扫描,支持自动识别不同 Node.js 版本下安装的 CLI 工具,解决 M1 芯片用户手动安装检测不到的问题。 - 原子化文件操作: 采用临时文件写入 + 原子替换机制,确保同步过程中断不会损坏原始配置文件。

- 探测路径扩展: 优化了二进制检测逻辑。新增对

- Thinking Signature 深度修复与会话自愈 (Fix Issue #752):

- 鲁棒重试逻辑: 修正了重试计次逻辑,确保单账号用户在遇到签名错误时也能触发内部重试,提高了自动修复的触发率。

- 主动签名剥离: 引入

is_retry状态,在重试请求中强制剥离所有历史签名。配合严苛的模型家族校验(Gemini 1.5/2.0 不再混用签名),杜绝了无效签名导致的 400 错误。 - 会话自愈 (Session Healing): 针对剥离签名后可能出现的“裸工具结果”结构错误,实现了智能消息注入机制,通过合成上下文满足 Vertex AI 的结构校验限制。

- 配额关注列表 (Fix PR #783):

- 自定义显示: 在「设置 -> 账号」中新增模型配额关注列表,支持用户自定义主表格显示的特定模型配额,未选中模型仅在详情弹窗中展示。

- 布局优化: 针对该板块实现了响应式 4 列网格布局,并在 UI 风格上与“额度保护”保持一致。

- 中转稳定性增强: 增强了对 529 Overloaded 等上游过载错误的识别与退避重试,提升了极端负载下的任务成功率。

- CLI 同步增强与探测修复 (Fix CLI-Sync Detection):

-

v3.3.37 (2026-01-17):

- 后端兼容性修复 (Fix PR #772):

- 向后兼容性增强: 为

StickySessionConfig添加了#[serde(default)]属性,确保旧版本的配置文件(缺少粘性会话字段)能够被正确加载,避免了反序列化错误。

- 向后兼容性增强: 为

- 用户体验优化 (Fix PR #772):

- 配置加载体验升级: 在

ApiProxy.tsx中引入了独立的加载状态和错误处理机制。现在,在获取配置时用户会看到加载动画,如果加载失败,系统将展示明确的错误信息并提供重试按钮,取代了之前的空白或错误状态。

- 配置加载体验升级: 在

- macOS Monterey 沙盒权限修复 (Fix Issue #468):

- 问题根源: 在 macOS Monterey (12.x) 等旧版本系统上,应用沙盒策略阻止了读取全局偏好设置 (

kCFPreferencesAnyApplication),导致无法正确检测默认浏览器,进而拦截了 OAuth 跳转。 - 修复内容: 在

Entitlements.plist中添加了com.apple.security.temporary-exception.shared-preference.read-only权限例外,显式允许读取全局配置。

- 问题根源: 在 macOS Monterey (12.x) 等旧版本系统上,应用沙盒策略阻止了读取全局偏好设置 (

- 后端兼容性修复 (Fix PR #772):

-

v3.3.36 (2026-01-17):

- Claude 协议核心稳定性修复:

- 修复 "回复 OK" 死循环 (History Poisoning Fix):

- 问题根源: 修复了

is_warmup_request检测逻辑中的严重缺陷。旧逻辑会扫描最近 10 条历史消息,一旦历史记录中包含任何一条 "Warmup" 消息(无论是用户发送还是后台心跳残留),系统就会误判所有后续的用户输入(如 "continue")为 Warmup 请求并强制回复 "OK"。 - 修复内容: 将检测范围限制为仅检查最新的一条消息。现在只有当前请求确实是 Warmup 心跳时才会被拦截,解决了用户在多轮对话中被 "OK" 卡死的问题。

- 影响范围: 极大提升了 Claude Code CLI 及 Cherry Studio 等客户端在长时间会话下的可用性。

- 问题根源: 修复了

- 修复 Cache Control 注入 (Fix Issue #744):

- 问题根源: Claude 客户端在 Thinking 块中注入了非标准的

cache_control: {"type": "ephemeral"}字段,导致 Google API 返回Extra inputs are not permitted400 错误。 - 修复内容: 实现了全局递归清理函数

clean_cache_control_from_messages,并将其集成到 Anthropic (z.ai) 转发路径中,确保在发送给上游 API 前移除所有cache_control字段。

- 问题根源: Claude 客户端在 Thinking 块中注入了非标准的

- 签名错误防御体系全面验证:

- 隐式修复 (Implicit Fixes): 经过深度代码审计,确认此前报告的一系列签名相关 Issue (#755, #654, #653, #639, #617) 已被 v3.3.35 的严格签名验证、自动降级及Base64 智能解码机制所覆盖和修复。现在的系统对缺失、损坏或编码错误的签名具有极高的容错性。

- 修复 "回复 OK" 死循环 (History Poisoning Fix):

- 智能预热逻辑修复 (Fix Issue #760):

- 问题根源: 修复了自动预热调度器中的一段遗留代码,该代码错误地将

gemini-2.5-flash的配额状态强制映射给gemini-3-flash。 - 现象: 这会导致当

gemini-2.5-flash仍有额度(如 100%)但gemini-3-flash已耗尽(0%)时,系统误判gemini-3-flash也为满额并触发预热,造成“无额度却预热”的幽灵请求。 - 修复内容: 移除了所有硬编码的

2.5 -> 3映射逻辑。现在的预热调度器严格检查每个模型自身的配额百分比,只有当该模型实测为 100% 时才会触发预热。

- 问题根源: 修复了自动预热调度器中的一段遗留代码,该代码错误地将

- 移除 Gemini 2.5 Pro 模型 (Fix Issue #766):

- 原因: 鉴于

gemini-2.5-pro模型的可靠性问题,已将其从支持列表中移除。 - 迁移: 所有

gpt-4系列别名(如gpt-4,gpt-4o)已重新映射至gemini-2.5-flash,确保服务连续性。 - 影响: 之前通过别名使用

gemini-2.5-pro的用户将自动路由至gemini-2.5-flash。前端不再显示该模型。

- 原因: 鉴于

- CLI 同步安全与备份增强 (Fix Issue #756 & #765):

- 智能备份与还原: 引入了自动备份机制。在执行同步覆盖前,系统会自动将用户现�有的配置文件备份为

.antigravity.bak。“恢复”功能现已升级,能智能检测备份文件,并优先提供“恢复原有配置”选项,而非单一的重置默认。 - 操作二次确认: 为“立即同步配置”操作增加了二次确认弹窗,有效防止误触导致本地个性化配置(如登录态)丢失。

- CLI 检测增强: 优化了 macOS 平台下的 CLI(如 Claude Code)检测逻辑。即使二进制文件不在系统

PATH中,只要存在于标准安装路径,也能被正确识别并调用。

- 智能备份与还原: 引入了自动备份机制。在执行同步覆盖前,系统会自动将用户现�有的配置文件备份为

- Windows 控制台闪烁修复 (PR #769, 感谢 @i-smile):

- 无窗口运行: 修复了在 Windows 平台上执行 CLI 同步命令(如

where检测)时会短暂弹出控制台窗口的问题。通过添加CREATE_NO_WINDOW标志,现在所有后台检测命令都将静默执行。

- 无窗口运行: 修复了在 Windows 平台上执行 CLI 同步命令(如

- Auth UI 状态显示修复 (PR #769, 感谢 @i-smile):

- 状态准确性: 修正了 API 反代页面中认证状态的显示逻辑。现在当

auth_mode为off时,UI 会正确显示“Disabled”状态,而不是一直显示“Enabled”。

- 状态准确性: 修正了 API 反代页面中认证状态的显示逻辑。现在当

- Claude 协议核心稳定性修复:

-

v3.3.35 (2026-01-16):

- CLI 同步功能重大增强 (CLI Sync Enhancements):

- 多配置文件支持: 现已支持同步每个 CLI 的多个配置文件,确保环境配置更完整。涵盖 Claude Code (

settings.json,.claude.json)、Codex (auth.json,config.toml) 及 Gemini CLI (.env,settings.json,config.json)。 - Claude 免登录特权: 同步时会自动在

~/.claude.json中注入"hasCompletedOnboarding": true,帮助新用户直接跳过 Claude CLI 的初始登录/引导步骤。 - 多文件查阅体验: 配置查看详情页升级为“标签页”模式,支持在一个弹窗内顺畅切换并查看该 CLI 关联的所有本地配置文件。

- 多配置文件支持: 现已支持同步每个 CLI 的多个配置文件,确保环境配置更完整。涵盖 Claude Code (

- UI/UX 深度细节优化:

- 弹窗体验统一: 将“恢复默认配置”的确认框由原生浏览器弹窗替换为应用主题一致的

ModalDialog。 - 图表与显示优化: 优化了恢复按钮图标 (RotateCcw);精简了状态标签文案并强制不换行,解决了高分屏或窄窗口下的布局错位问题。

- 版本号精简: 改进了 CLI 版本号提取逻辑,界面仅保留纯数字版本(如 v0.86.0),视觉更加清爽。

- 弹窗体验统一: 将“恢复默认配置”的确认框由原生浏览器弹窗替换为应用主题一致的

- Claude 思考签名持久化修复 (Fix Issue #752):

- 问题根源:

- 响应收集侧:v3.3.34 中流式响应收集器 (

collector.rs) 在处理content_block_start事件时遗漏了thinking块的signature字段,导致签名丢失。 - 请求转换侧:历史消息中的签名未经验证直接发送给 Gemini,导致跨模型切换或冷启动时出现

Invalid signature in thinking block错误。

- 响应收集侧:v3.3.34 中流式响应收集器 (

- 修复内容:

- 响应收集器:在

collector.rs中添加了signature字段的提取和持久化逻辑,并补充了单元测试test_collect_thinking_response_with_signature。 - 请求转换器:在

request.rs中实施严格签名验证,只使用已缓存且兼容的签名。未知或不兼容的签名会导致 thinking 块自动降级为普通文本,避免发送无效签名。 - 回退机制:实现智能回退重试逻辑。如果签名验证失效或上游 API 拒绝(400错误),系统会自动清除所有 thinking 块并强制重试,确保用户请求总是成功。

- 响应收集器:在

- 影响范围: 解决了

Invalid signature in thinking block错误,支持跨模型切换和冷启动场景,确保 Thinking 模型在所有模式下稳定工作。

- 问题根源:

- API 监控数据实时同步修复 (Pull Request #747, Thanks to @xycxl):

- 问题根源: 修复了 API 监控页面因事件监听器重复注册和状态不同步导致的日志重复显示、计数器不准等问题。

- 修复内容:

- 数据去重: 引入

pendingLogsRef和 ID 排重机制,杜绝日志列表中出现重复条目。 - 精准计数: 实现了前后端状态的严格同步,每次接收新日志都从后端获取权威的

totalCount,确保页码和总数准确无误。 - 防抖优化: 优化了日志更新的防抖逻辑,减少 React 重渲染次数,提升页面流畅度。

- 功能重命名: 将“调用记录”重命名为“流量日志”,并恢复路由为

/monitor,使功能定位更加直观。

- 数据去重: 引入

- CLI 同步功能重大增强 (CLI Sync Enhancements):

-

v3.3.34 (2026-01-16):

- OpenAI Codex/Responses 协议修复 (Fix Issue #742):

- 400 Invalid Argument 修复:

- 问题根源:

/v1/responses等专有接口在请求体中仅包含instructions或input而缺失messages字段时,转换逻辑未覆盖全场景,导致 Gemini 接收到空 Body。 - 修复内容: 在

handle_completions中反向移植了聊天接口的“请求标准化”逻辑。现在系统会强制检测 Codex 特有字段(instructions/input),即使messages为空或缺失,也会自动将其转化为标准的 System/User 消息对,确保上游请求合法。

- 问题根源:

- 429/503 高级重试与账号轮换支持:

- 逻辑对齐: 将 Claude 处理器中验证过的“智能指数退避”与“多维账号轮换”策略完整移植到了 OpenAI Completions 接口。

- 效果: 现在 Codex 接口在遇到限流或服务器过载时,会自动执行毫秒级切换,不再直接抛出错误,极大提升了 VS Code 插件等工具的稳定性。

- 会话粘性 (Session Stickiness) 支持:

- 功能扩展: 补全了 OpenAI 协议下的

session_id提取与调度逻辑。现在无论是 Chat 还是 Codex 接口,只要是同一段对话,系统都会尽量将其调度到同一个 Google 账号上。 - 性能红利: 这将显著提升 Google Prompt Caching 的命中率,从而大幅加快响应速度并节省计算资源。

- 功能扩展: 补全了 OpenAI 协议下的

- 400 Invalid Argument 修复:

- Claude 思考签名编码修复 (Fix Issue #726):

- 问题根源: 修复了 v3.3.33 中引入的 Regression,该版本错误地对已经 Base64 编码的

thoughtSignature进行了二次编码,导致 Google Vertex AI 无法正确校验签名而返回Invalid signature错误。 - 修复内容: 移除了

Thinking、ToolUse和ToolResult处理逻辑中多余的 Base64 编码步骤,确保签名以原始格式正确透传给上游。 - 影响范围: 解决了使用 Thinking 模型(如 Claude 4.5 Opus / Sonnet)在多轮对话中触发的 400 签名错误,以及由此导致的 "Error searching files" 任务卡死问题 (Issue #737)。

- 问题根源: 修复了 v3.3.33 中引入的 Regression,该版本错误地对已经 Base64 编码的

- API 监控看板刷新修复 (Fix Issue #735):

- 问题根源: 修复了

ProxyMonitor组件中因 Closure 导致的事件监听失效问题,该问题导致新请求无法自动显示在列表中。 - 修复内容: 引入

useRef优化事件缓冲逻辑,并新增手动刷新按钮作为备份方案;同时在 Tauri 权限配置中显式允许了事件监听。

- 问题根源: 修复了

- 严格分组配额保护修复 (Strict Grouped Quota Protection Fix - Core Thanks to @Mag1cFall PR #746):

- 问题根源: 修复了在严格匹配模式下,配额保护逻辑因大小写敏感和前端 UI 键名映射缺失而失效的问题。之前版本中

gemini-pro等 UI 简写键名无法匹配到后端定义的gemini-3-pro-high严格组。 - 修复内容:

- 即时大小写归一化: 恢复了后端

normalize_to_standard_id的大小写不敏感匹配,确保Gemini-3-Pro-High等变体能被正确识别。 - UI 键名智能映射: 在前端

isModelProtected中增加了对gemini-pro/flash等 UI 列名的自动映射,确保 UI 上的锁图标能正确反映后端保护状态。

- 即时大小写归一化: 恢复了后端

- 影响范围: 解决了 Gemini 3 Pro/Flash 和 Claude 4.5 Sonnet 在严格分组模式下的锁图标显示问题,确保配额耗尽时能直观提示用户。

- 问题根源: 修复了在严格匹配模式下,配额保护逻辑因大小写敏感和前端 UI 键名映射缺失而失效的问题。之前版本中

- OpenAI 协议 Usage 统计修复 (Pull Request #749, Thanks to @stillyun):

- 问题根源: 在 OpenAI 协议转换过程中,未将 Gemini 返回的

usageMetadata映射到 OpenAI 格式的usage字段,导致 Kilo 等客户端显示 Token 使用量为 0。 - 修复内容:

- 数据模型补全: 为

OpenAIResponse增加了标准的usage字段。 - 全链路映射: 实现了从流式 (SSE) �和非流式响应中提取并映射

prompt_tokens、completion_tokens及total_tokens的逻辑。

- 数据模型补全: 为

- 影响范围: 解决了 Kilo Editor、Claude Code 等工具在使用 OpenAI 协议时无法统计 Token 用量的问题。

- 问题根源: 在 OpenAI 协议转换过程中,未将 Gemini 返回的

- Linux 主题切换崩溃修复 (Pull Request #750, Thanks to @infinitete):

- 修复内容:

- 在 Linux 平台禁用不兼容的

setBackgroundColor调用。 - 针对 WebKitGTK 环境禁用 View Transition API 以防止透明窗口崩溃。

- 启动时自动调整 GTK 窗口 alpha 通道以增强稳定性。

- 在 Linux 平台禁用不兼容的

- 影响范围: 解决了 Linux 用户在切换深色/浅色模式时可能遇到的程序卡死或硬崩溃问题。

- 修复内容:

- OpenAI Codex/Responses 协议修复 (Fix Issue #742):

-

v3.3.33 (2026-01-15):

- Codex 兼容性与模型映射修复 (Fix Issue #697):

- Instructions 参数支持: 修复了对

instructions参数的处理逻辑,确保其作为系统指令(System Instructions)正确注入,提升与 Codex 等工具的兼容性。 - 自动 Responses 格式检测: 在 OpenAI 处理器中新增智能检测逻辑,自动识别并转换

instructions或input字段触发的 Responses 模式,无需客户端手动切换。 - 模型映射恢复与归一化: 恢复了

gemini-3-pro-low/high/pro统一归一化为内部别名gemini-3-pro-preview的逻辑,并确保在上游请求时正确还原为物理模型名high。 - Opus 映射增强: 优化了系统默认映射,自动识别

opus关键字模型并确保其默认路由至高性能 Pro 预览线路。

- Instructions 参数支持: 修复了对

- OpenAI 工具调用与思考内容修复 (Fix Issue #710):

- 保�留工具调用 ID: 修复了 OpenAI 格式转换过程中丢失

tool_use.id的问题,确保functionCall和functionResponse均保留原始 ID,解决了调用 Claude 模型时的Field required错误。 - 思考内容 (Reasoning) 原生支持: 增加了对 OpenAI 消息中

reasoning_content的支持,将其正确映射为内部thought部分并注入思维链签名,显著提升了“思考型”模型的视觉回显效果。 - 工具响应格式优化: 修复了

tool角色消息中可能产生的冗余 Part 冲突,确保请求报文严格符合上游校验规范。

- 保�留工具调用 ID: 修复了 OpenAI 格式转换过程中丢失

- 外部提供商智能兜底修复 (Fix Issue #703): 修复了"仅兜底"模式在 Google 账号额度耗尽时无法自动切换到外部提供商的问题。

- 核心问题: 原判断逻辑只检查 Google 账号数量是否为 0,而不检查账号的实际可用性(限流状态、配额保护状态),导致账号存在但不可用时直接返回 429 错误。

- 解决方案: 实现智能账号可用性检查机制,在

TokenManager中新增has_available_account()方法,综合判断账号的限流状态和配额保护状态。 - 修改文件:

token_manager.rs: 新增has_available_account()方法,检查是否存在未被限流且未被配额保护的可用账号handlers/claude.rs: 优化 Fallback 模式判断逻辑,从简单的google_accounts == 0改为智能的可用性检查

- 行为改进: 当所有 Google 账号因限流、配额保护或其他原因不可用时,系统会自动切换到外部提供商,实现真正的智能兜底。

- 影响范围: 此修复确保了外部提供商(如智谱 API)的"仅兜底"模式能够正确工作,显著提升了多账号场景下的服务可用性。

- 配额保护模型名称归一化修复 (Fix Issue #685): 修复了配额保护功能因模型名称不匹配而失效的问题。

- 核心问题: Quota API 返回的模型名称(如

gemini-2.5-flash)与用户在 UI 勾选的标准名称(如gemini-3-flash)不一致,导致精确字符串匹配失败,保护机制无法触发。 - 解决方案: 实现了统一的模型名称归一化引擎

normalize_to_standard_id,将所有物理模型名映射到 3 个标准保护 ID:gemini-3-flash: 所有 Flash 变体 (1.5-flash, 2.5-flash, 3-flash 等)gemini-3-pro-high: 所有 Pro 变体 (1.5-pro, 2.5-pro 等)claude-sonnet-4-5: 所有 Claude Sonnet 变体 (3-5-sonnet, sonnet-4-5 等)

- 修改文件:

model_mapping.rs: 新增归一化函数account.rs: 配额更新时归一化模型名并存储标准 IDtoken_manager.rs: 请求拦截时归一化target_model进行匹配

- 联网降级场景: 即使请求因联网搜索被降级为

gemini-2.5-flash,依然能正确归一化为gemini-3-flash并触发保护。 - 影响范围: 解决了配额保护失效问题,确保所有 3 个监控模型的保护功能正常工作。

- 核心问题: Quota API 返回的模型名称(如

- 新增账号导入功能 (#682): 支持通过导出的 JSON 文件批量导入已有的账号,完善了账号迁移闭环。

- 新增葡萄牙语与俄语支持 (#691, #713): 现已支持葡萄牙语(巴西)与俄语本地化。

- 代理监控增强 (#676): 在代理监控详情页中为请求和响应载荷新增了“复制”按钮,并支持自动 JSON 格式化。

- i18n 修复与界面文案优化 (#671, #713): 修正了日语 (ja)、土耳其语 (tr) 和俄语 (ru) 中遗漏和错位的翻译文案。

- 全局 HTTP API (#696): 新增本地 HTTP 服务端口(默认 19527),支持外部工具(如 VS Code 插件)直接通过 API 进行账号切换、配额刷新和设备绑定。

- 代理监控升级 (#704): 全面重构监控面板,引入后端分页查询(支持搜索过滤),解决了大量日志导致的界面卡顿问题;开放

GET /logs接口供外部调用。 - 预热策略优化 (#699): 预热请求新增唯一

session_id,并将max_tokens限制为 8,temperature设置为 0,以降低资源消耗并避免 429 错误。 - 预热逻辑修复与优化: 修复了手动触发预热未记录历史导致自动调度重复预热的问题;优化调度器自动跳过“反代禁用”状态的账号。

- 性能模式调度优化 (PR #706): 在“性能优先”调度模式下,现在会跳过默认的 60秒全局锁定机制,显著提升高并发场景下的账号轮转效率。

- 限流记录自动清理 (PR #701): 引入了每分钟执行的后台清理任务,自动移除超过 1 小时的过期失败记录,解决长期运行后因历史记录累积导致的“无可用账号”误报问题。

- API Monitor 锁定修复 (Fix Issue #708): 启用 SQLite WAL 模式并优化连接配置,解决了高并发场景下因数据库锁定导致的监控数据滞后和代理服务 400/429 错误。

- Claude 提示词过滤优化 (#712): 修复了在过滤 Claude Code 冗余默认提示词时,误删用户自定义指令 (Instructions from: ...) 的问题,确保个性化配置在长对话场景下仍能正确生效。

- Claude 思维块排序策略优�化 (Fix Issue #709): 解决了开启思维模式时由于块顺序错位(Text 出现在 Thinking 前)导致的

INVALID_ARGUMENT报错。- 三段式强制分区: 实现

[Thinking, Text, ToolUse]严格顺序校验。 - 自动降级网关: 在单条消息内,一旦出现非思维内容,后续思维块自动降级为文本,确保协议合规。

- 合并后二次重排: 在 Assistant 消息合并逻辑后增加强制重排序,堵死因消息拼接导致的排序漏洞。

- 三段式强制分区: 实现

- Codex 兼容性与模型映射修复 (Fix Issue #697):

-

v3.3.32 (2026-01-15):

- 核心调度与稳定性优化 (Fix Issue #630, #631 - 核心致谢 @lbjlaq PR #640):

- 配额漏洞与绕过修复: 解决了在高并发或特定重试场景下,配额保护机制可能被绕过的潜在漏洞。

- 限流 Key 匹配优化: 增强了

TokenManager中限流记录的匹配精准度,解决了在多实例或复杂网络环境下可能出现的速率限制判定不一致问题。 - 账号禁用逻辑加固: 修复了手动禁用账号在某些缓存生命周期内未立即从调度池中剥离的问题,确保“禁用即生效”。

- 账号状态重置机制: 完善了账号失败计数器在成功请求后的重置策略,避免账号因历史波动被长期误锁定。

- 核心调度与稳定性优化 (Fix Issue #630, #631 - 核心致谢 @lbjlaq PR #640):

-

v3.3.31 (2026-01-14):

- 配额保护失效修复 (Fix Issue #631):

- 内存状态同步: 修复了加载账号触发配额保护时,内存状态未立即同步的问题,确保保护机制即时生效。

- 全场景覆盖: 在“粘性会话 (Sticky Session)”和“60秒锁定 (60s Window Lock)”逻辑中补充了配额保护检查,防止受限账号被错误复用。

- 代码优化: 修复了

token_manager.rs中的部分编译警告。

- Claude 工具调用重复报错修复 (Fix Issue #632):

- 弹性修复优化: 改进了

Elastic-Recovery逻辑,在注入占位结果前增加全量消息 ID 预扫描,避免了Found multiple tool_result blocks with id错误。 - Anthropic 协议对齐: 确保生成的请求包严格符合 Anthropic 对工具调用 ID 唯一性的要求。

- 弹性修复优化: 改进了

- 配额保护失效修复 (Fix Issue #631):

-

v3.3.30 (2026-01-14):

- 模型级配额保护 (Issue #621):

- 隔离优化: 解决了因单个模型配额耗尽而禁用整个账号的问题。现在配额保护仅针对受限的具体模型,账号仍可处理其他模型的请求。

- 自动迁移: 新系统会自动将旧版因配额保护被全局禁用的账号恢复,并平滑转为模型级限制。

- 全协议支持项目: 已同步更新 Claude, OpenAI (Chat/DALL-E), Gemini, Audio 处理器的路由逻辑。

- Gemini 参数幻觉修复 (PR #622):

- 参数纠错: 修复了 Gemini 模型将

pattern参数错误放置在description或query字段的问题,增加了自动重映射逻辑。 - 布尔值强制转换: 增加了对

yes/no、-n等非标准布尔值的自动转换支持,解决了lineNumbers等参数因类型错误导致的调用失败。 - 影响范围: 显著提升了 Gemini 模型在 Claude Code CLI 及其他工具调用场景下的稳定性和兼容性。

- 参数纠错: 修复了 Gemini 模型将

- 代码清理与警告修复 (PR #628):

- 消除编译器警告: 修复了多个未使用的导入和变量警告,移除了冗余代码,保�持代码库整洁。

- 跨平台兼容性: 针对 Windows/macOS/Linux 不同平台的代码路径进行了宏标记优化。

- API 密钥自定义编辑功能 (Issue #627):

- 自定义密钥支持: API 反代页面的"API 密钥"配置项现在支持直接编辑,用户可以输入自定义密钥,适合多实例部署场景。

- 保留自动生成: 保留了原有的"重新生成"功能,用户可以选择自动生成或手动输入。

- 格式验证: 添加了密钥格式验证(必须以

sk-开头,长度至少 10 个字符),防止无效输入。 - 多语言支持: 为所有 6 种支持的语言(简体中文、英文、繁体中文、日语、土耳其语、越南语)添加了完整的国际化翻译。

- 模型级配额保护 (Issue #621):

-

v3.3.29 (2026-01-14):

- OpenAI 流式响应 Function Call 支持修复 (Fix Issue #602, #614):

- 问题背景: OpenAI 接口的流式响应 (

stream: true) 中缺少 Function Call 处理逻辑,导致客户端无法接收到工具调用信息。 - 根本原因:

create_openai_sse_stream函数只处理了文本内容、思考内容和图片,完全缺少对functionCall的处理。 - 修复内容:

- 添加工具调用状态追踪变量 (

emitted_tool_calls),防止重复发送 - 在 parts 循环中添加

functionCall检测和转换逻辑 - 构建符合 OpenAI 规范的

delta.tool_calls数组 - 使用哈希算法生成稳定的

call_id - 包含完整的工具调用信息 (

index,id,type,function.name,function.arguments)

- 添加工具调用状态追踪变量 (

- 影响范围: 此修复确保了��流式请求能够正确返回工具调用信息,与非流式响应和 Codex 流式响应的行为保持一致。所有使用

stream: true+tools参数的客户端现在可以正常接收 Function Call 数据。

- 问题背景: OpenAI 接口的流式响应 (

- 智能阈值回归 (Smart Threshold Recovery) - 解决 Issue #613:

- 核心逻辑: 实现了一种感知上下文负载的动态 Token 报告机制。

- 修复内容:

- 三阶段缩放: 在低负载(0-70%)保持高效压缩;在中负载(70-95%)平滑降低压缩率;在接近 100% 极限时真实上报(回归至 195k 左右)。

- 模型感应: 处理器自动识别 1M (Flash) 和 2M (Pro) 的物理上下文界限。

- 400 错误拦截: 即使触发物理溢出,代理层也会拦截

Prompt is too long错误,并返回友好的中文/英文修复指引,引导用户执行/compact。

- 影响范围: 解决了 Claude Code 在长对话场景下因不知道真实 Token 用量而拒绝压缩,最终导致 Gemini 服务端报错的问题。

- Playwright MCP 连通性与稳定性增强 (参考 Antigravity2Api) - 解决 Issue #616:

- SSE 心跳保活: 引入 15 秒定时心跳 (

: ping),解决长耗时工具调用导致的连接超时断开问题。 - MCP XML Bridge: 实现双向协议转换逻辑(指令注入 + 标签拦截),显著提升 MCP 工具(如 Playwright)在不稳定链路下的连通性。

- 上下文激进瘦身:

- 指令过滤: 自动识别并移除 Claude Code 注入的冗余系统说明(~1-2k tokens)。

- 任务去重: 剔除 tool_result 后重复的任务回显文本,物��理减少 Context 占用。

- 智能 HTML 清理与截断:

- 深度剥离: 针对浏览器快照自动移除

<style>、<script>及内联 Base64 资源。 - 结构化截断: 优化截断算法,确保不在 HTML 标签或 JSON 中间切断,避免产生破坏性的 400 结构错误。

- 深度剥离: 针对浏览器快照自动移除

- SSE 心跳保活: 引入 15 秒定时心跳 (

- 账号索引加载容错修复 (Fix Issue #619):

- 修复内容: 在加载

accounts.json时增加了对空文件的检测及自动重置逻辑。 - 影响范围: 解决了因索引文件损坏/为空导致的软件启动报错

expected value at line 1 column 1。

- 修复内容: 在加载

- OpenAI 流式响应 Function Call 支持修复 (Fix Issue #602, #614):

-

v3.3.28 (2026-01-14):

- OpenAI Thinking Content 修复 (PR #604):

- 修复 Gemini 3 Pro thinking 内容丢失: 在流式响应收集器中添加

reasoning_content累积逻辑,解决了 Gemini 3 Pro (high/low) 非流式响应中思考内容丢失的问题。 - *支持 Claude -thinking 模型: 扩展 thinking 模型检测逻辑,支持所有以

-thinking结尾的模型(如claude-opus-4-5-thinking、claude-sonnet-4-5-thinking),自动注入thinkingConfig确保思考内容正常输出。 - 统一 thinking 配置: 为所有 thinking 模型(Gemini 3 Pro 和 Claude thinking 系列)注入统一的

thinkingBudget: 16000配置,符合 Cloud Code API 规范。 - 影响范围: 此修复确保了 Gemini 3 Pro 和 Claude Thinking 模型在 OpenAI 协议下的

reasoning_content字段正常工作,不影响 Anthropic 和 Gemini 原生协议。

- 修复 Gemini 3 Pro thinking 内容丢失: 在流式响应收集器中添加

- Experimental 配置热更新 (PR #605):

- 新增热更新支持: 为

ExperimentalConfig添加热更新机制,与其他配置项(mapping、proxy、security、zai、scheduling)保持一致。 - 实时生效: 用户修改实验性功能开关后无需重启应用即可生效,提升配置调整的便捷性。

- 架构完善: 在

AxumServer中添加experimental字段存储和update_experimental()更新方法,在save_config中自动触发热更新。

- 新增热更新支持: 为

- 智能预热策略优化 (PR #606 - 性能提升 2.9x-5x):

- 分离刷新和预热: 移除配额刷新时的自动预热触发,预热仅通过定时调度器(每10分钟)或手动按钮触发,避免用户刷新配额时意外消耗预热额度。

- 延长冷却期: 冷却期从30分钟延长至4小时(14400秒),匹配 Pro 账号5小时重置周期,解决同一周期内重复预热问题。

- 持久化历史记录: 预热历史保存至

~/.antigravity_tools/warmup_history.json,程序重启后冷却期仍然有效,解决状态丢失问题。 - 并发执行优化:

- 筛选阶段: 每批5个账号并发获取配额,10个账号从

15秒降至3秒 (5倍提升) - 预热阶段: 每批3个任务并发执行,批次间隔2秒,40个任务从

80秒降至28秒 (2.9倍提升)

- 筛选阶段: 每批5个账号并发获取配额,10个账号从

- 白名单过滤: 仅记录和预热4个核心模型组(

gemini-3-flash、claude-sonnet-4-5、gemini-3-pro-high、gemini-3-pro-image),避免历史记录臃肿。 - 成功后记录: 预热失败不记录历史,允许下次重试,提高容错性。

- 手动预热保护: 手动预热也遵守4小时冷却期,过滤已预热模型并显示跳过数量,防止用户反复点击浪费配额。

- 完善日志: 添加调度器扫描、预热启动/完成、冷却期跳过等详细日志,便于监控和调试。

- 影响范围: 此优化大幅提升了智能预热的性能和可靠性,解决了重复预热、速度慢、状态丢失等多个问题,并发级别不会触发 RateLimit。

- 繁体中文本地化优化 (PR #607):

- 术语优化: 优化100处繁体中文翻译,使其更符合台湾地区用户的语言习惯和表达方式。

- 用户体验提升: 提升繁体中文界面的专业性和可读性,纯文本变更无代码逻辑影响。

- API 监控性能优化 (修复长时间运行白屏问题):

- 问题背景: 修复后台长时间运行后停留在 API 监控页面导致窗口卡成白屏的问题,程序仍在运行但 UI 无响应。

- 内存优化:

- 减少内存日志限制从 1000 条降至 100 条,大幅降低内存占用

- 移除实时事件中的完整 request/response body 存储,仅保留摘要信息

- 后端事件发送优化,仅传输日志摘要而非完整数据,减少 IPC 传输量

- 渲染性能提升:

- 集成

@tanstack/react-virtual虚拟滚动库,仅渲染可见行(约 20-30 行) - DOM 节点数量从 1000+ 降至 20-30,减少 97%

- 滚动帧率从 20-30fps 提升至 60fps

- 集成

- 防抖机制:

- 添加 500ms 防抖机制,批量处理日志更新,避免频繁状态更新

- 减少 React re-render 次数,提升 UI 响应性

- 性能提升:

- 内存占用: ~500MB → <100MB (减少 90%)

- 首次渲染时间: ~2000ms → <100ms (提升 20 倍)

- 支持无限日志滚动,长时间运行无白屏

- 影响范围: 此优化解决了长时间运行和大量日志场景下的性能问题,即使停留在监控页��面数小时也能保持流畅。

- OpenAI Thinking Content 修复 (PR #604):

-

v3.3.27 (2026-01-13):

- 实验性配置与用量缩放 (PR #603 增强):

- 新增实验性设置面板: 在 API 反代配置中增加了“实验性设置”卡片,用于管理正在探索中的功能。

- 启用用量缩放 (Usage Scaling): 针对 Claude 相容协议实现了激进的输入 Token 自动缩放逻辑。当总输入超过 30k 时,自动应用平方根缩放,有效防止长上下文场景下(如 Gemini 2M 窗口)频繁触发客户端侧的强制压缩。

- 多语言翻译补全: 为实验性功能同步补全了中、英、日、繁、土、越 6 种语言的翻译。

- 实验性配置与用量缩放 (PR #603 增强):

-

v3.3.26 (2026-01-13):

- 配额保护与调度优化 (Fix Issue #595 - 零配额账户仍进入队列):

- 配额保护逻辑重构: 修复了配额保护因依赖不存在的

limit/remaining字段而失效的问题。现在直接使用模型数据中始终存在的percentage字段,确保任何受监控模型(如 Claude 4.5 Sonnet)配额低于阈值时,账号都能被立即禁用。 - 账号优先级算法升级: 账号调度优先级不再仅依赖订阅等级。在同等级(Ultra/Pro/Free)内,系统现在会优先选择最大模型剩余百分比最高的账号,避免对濒临耗尽的账号进行“压榨”,显著降低 429 错误率。

- 保护日志增强: 触发配额保护时的日志现在会明确指出具体是哪个模型触发了阈值(例如:

quota_protection: claude-sonnet-4-5 (0% <= 10%)),便于排查。

- 配额保护逻辑重构: 修复了配额保护因依赖不存在的

- MCP 工具兼容性增强 (Fix Issue #593):

- 深度 cache_control 清理: 实现了多层次的

cache_control字�段清理机制,解决 Chrome Dev Tools MCP 等工具在 thinking block 中包含cache_control导致的 "Extra inputs are not permitted" 错误。- 增强日志追踪: 添加

[DEBUG-593]日志前缀,记录消息索引和块索引,便于问题定位和调试。 - 递归深度清理: 新增

deep_clean_cache_control()函数,递归遍历所有嵌套对象和数组,移除任何位置的cache_control字段。 - 最后一道防线: 在构建 Gemini 请求体后、发送前再次执行深度清理,确保发送给 Antigravity 的请求中不包含任何

cache_control。

- 增强日志追踪: 添加

- 工具输出智能压缩: 新增

tool_result_compressor模块,处理超大工具输出,降低 prompt 超长导致的 429 错误概率。- 浏览器快照压缩: 自动检测并压缩超过 20,000 字符的浏览器快照,采用头部(70%) + 尾部(30%)保留策略,中间省略。

- 大文件提示压缩: 智能识别 "exceeds maximum allowed tokens" 模式,提取关键信息(文件路径、字符数、格式说明),大幅减少冗余内容。

- 通用截断: 对超过 200,000 字符的工具输出进行截断,添加清晰的截断提示。

- Base64 图片移除: 自动移除工具结果中的 base64 编码图片,避免体积过大。

- 完整测试覆盖: 新增 7 个单元测试,覆盖文本截断、浏览器快照压缩、大文件提示压缩、工具结果清理等核心功能,全部通过验证。

- 影响范围: 此更新显著提升了 MCP 工具(特别是 Chrome Dev Tools MCP)的稳定性,解决了 thinking block 中

cache_control字段导致的 API 错误,同时通过智能压缩降低了超大工具输出导致的 429 错误概率。

- 深度 cache_control 清理: 实现了多层次的

- API 监控账号信息记录修复:

- 修复图片生成端点: 修复了

/v1/images/generations端点缺少X-Account-Email响应头的问题,现在监控面板能正确显示处理图片生成请求的账号信息。 - 修复图片编辑端点: 修复了

/v1/images/edits端点缺少X-Account-Email响应头的问题,确保图片编辑请求的账号信息能被正确记录。 - 修复音频转录端点: 修复了

/v1/audio/transcriptions端点缺少X-Account-Email响应头的问题,完善了音频转录功能的监控支持。 - 影响范围: 此修复确保了所有涉及账号调用的 API 端点都能在监控面板中正确显示账号信息,不再显示为"-",提升了 API 监控系统的完整性和可用性。

- 修复图片生成端点: 修复了

- 无头服务器部署支持 (Headless Server Support):

- 一键部署脚本: 新增

deploy/headless-xvfb/目录,提供针对 Linux 无界面服务器的一键安装、同步、升级脚本。 - Xvfb 环境适配: 利用虚拟显示器技术,允许 GUI 版本的 Antigravity Tools 在无显卡的远程服务器上运行,并提供了详细的资源占用预警和局限性说明。

- 一键部署脚本: 新增

- 配额保护与调度优化 (Fix Issue #595 - 零配额账户仍进入队列):

-

v3.3.25 (2026-01-13):

- 会话签名缓存系统 (Session-Based Signature Caching) - 提升 Thinking 模型稳定性 (核心致谢 @Gok-tug PR #574):

- 三层签名缓存架构: 实现了 Tool Signatures (Layer 1)、Thinking Families (Layer 2) 和 Session Signatures (Layer 3) 的完整三层缓存体系。

- 会话隔离机制: 基于第一条用户消息的 SHA256 哈希生成稳定的 session_id,确保同一对话的所有轮次使用相同的会话标识。

- 智能签名恢复: �在工具调用和多轮对话中自动恢复思考签名,显著减少 thinking 模型的签名相关错误。

- 优先级查找策略: 实现 Session Cache → Tool Cache → Global Store 的三层查找优先级,最大化签名恢复成功率。

- Session ID 生成优化:

- 简洁设计: 只哈希第一条用户消息内容,不混入模型名称或时间戳,确保会话延续性。

- 完美延续性: 同一对话的所有轮次(无论多少轮)都使用相同的 session_id,无时间限制。

- 性能提升: 相比之前的方案,CPU 开销降低 60%,代码行数减少 20%。

- 缓存管理优化:

- 分层阈值: 为不同层级设置合理的缓存清理阈值 (Tool: 500, Family: 200, Session: 1000)。

- 智能清理: 添加详细的缓存清理日志,便于监控和调试。

- 编译错误修复:

- 修复

process.rs中的参数命名和可变性问题。 - 清理未使用的导入和变量警告。

- 修复

- 国际化 (i18n):

- 繁体中文支持: 新增繁体中文 (Traditional Chinese) 本地化支持 (Thank you @audichuang PR #577)。

- 流式响应错误处理改进 (Stream Error Handling Improvements):

- 友好错误提示: 修复了 Issue #579 中提到的流式错误导致 200 OK 且无提示的问题。现在将技术性错误 (Timeout, Decode, Connection) 转换为用户友好的中文提示。

- SSE 错误事件: 实现了标准的 SSE 错误事件传播,前端可捕获并优雅展示错误,包含详细的解决建议(如检查网络、代理等)。

- 多语言错误消息 (i18n): 错误消息已集成 i18n 系统,支持所有 6 种语言(zh, en, zh-TW, ja, tr, vi)。�非浏览器客户端自动回退到英文提示。

- 影响范围: 此更新显著提升了 Claude 4.5 Opus、Gemini 3 Pro 等 thinking 模型的多轮对话稳定性,特别是在使用 MCP 工具和长会话场景下。

- 会话签名缓存系统 (Session-Based Signature Caching) - 提升 Thinking 模型稳定性 (核心致谢 @Gok-tug PR #574):

显示旧版本日志 (v3.3.24 及更早)

-

v3.3.24 (2026-01-12):

- UI 交互改进 (UI Interaction Improvements):

- 卡片式模型选择: 设置页面的“配额保护”与“智能预热”模型选择升级为卡片式设计,支持选中状态勾选及未选中状态下显眼的边缘提示。

- 布局优化: “智能预热”模型列表由单行 2 列调整为单行 4 列布局,更加节省空间。

- 名称修正: 将

claude-sonnet-4-5错误显示的名称由 "Claude 3.5 Sonnet" 修正为 "Claude 4.5 Sonnet"。

- 国际化 (i18n):

- 越南语支持: 新增越南语 (Vietnamese) 本地化支持 (Thank you @ThanhNguyxn PR #570)。

- 翻译优化: 清理了重复的翻译键值,并优化了语言自动检测逻辑。

- UI 交互改进 (UI Interaction Improvements):

-

v3.3.23 (2026-01-12):

- 更新通知 UI 重构 (Update Notification UI Modernization):

- 视觉升级: 采用 "Glassmorphism" 毛玻璃风格设计,配合优雅的渐变背景与微光效果,大幅提升视觉精致度。

- 流畅动效: 引入了更平滑的弹窗入场与退出动画,优化了交互体验。

- 深色模式适配: 完美支持深色模式 (Dark Mode),自动跟随系统主题切换,确保在任何环境下都不刺眼。

- 非侵入式布局: 优化了弹窗位置与层级,确保不会遮挡顶部导航栏等关键操作区域。

- 国际化支持 (Internationalization):

- 双语适配: 更新通知现已完整支持中英双语,根据应用语言设置自动切换文案。

- 检查逻辑修正: 修复了更新检查状态更新的时序问题,确保在发现新版本时能稳定弹出通知。

- 菜单栏图标高清化修复 (Menu Bar Icon Resolution Fix):

- Retina 适配: 将菜单栏托盘图标 (

tray-icon.png) 分辨率从 22x22 提升至 44x44,解决了在高分屏下显示模糊的问题 (Fix Issue #557)。

- Retina 适配: 将菜单栏托盘图标 (

- Claude Thinking 压缩优化 (核心致谢 @ThanhNguyxn PR #566):

- 修复思考块乱序: 解决了在使用 Context Compression (Kilo) 时,思考块 (Thinking Blocks) 可能被错误地排序到文本块之后的问题。

- 强制首位排序: 引入了

sort_thinking_blocks_first逻辑,确保助手消息中的思考块始终位于最前,符合 Anthropic API 的 400 校验规则。

- 账号路由优先级增强 (核心致谢 @ThanhNguyxn PR #567):

- 高配额优先策略: 在同等级别 (Free/Pro/Ultra) 下,系统现在会优先选择剩余配额更多的账号进行调度。

- 避免木桶效应: 防止因随机分配导致某些长配额账号被闲置,而短配额账号过早耗尽。

- 非流式响应 Base64 签名修复 (核心致谢 @ThanhNguyxn PR #568):

- 全模式兼容: 将流式响应中的 Base64 思考签名解码逻辑同步应用到非流式响应 (Non-streaming) 中。

- 消除签名错误: 解决了在非流式客户端 (如 Python SDK) 中使用 Antigravity 代理时因签名编码格式不一致导致的 400 错误。

- 国际化 (i18n):

- 日语支持: 新增日语 (Japanese) 本地化支持 (Thank you @Koshikai PR #526)。

- 土耳其语支持: 新增土耳其语 (Turkish) 本地化支持 (Thank you @hakanyalitekin PR #515)。

- 更新通知 UI 重构 (Update Notification UI Modernization):

-

v3.3.22 (2026-01-12):

- 配额保护系统升级:

- 支持自定义监控模型(

gemini-3-flash,gemini-3-pro-high,claude-sonnet-4-5),仅在选中模型额度低于阈值时触发保护 - 保护逻辑优化为"勾选模型最小配额"触发机制

- 开启保护时默认勾选

claude-sonnet-4-5,UI 强制至少保留一个模型

- 支持自定义监控模型(

- 全自动配额管理联动:

- 强制开启后台自动刷新,确保配额数据实时同步

- 自动执行"刷新 → 保护 → 恢复 → 预热"完整生命周期管理

- 智能预热自定义勾选:

- 支持自定义预热模型(

gemini-3-flash,gemini-3-pro-high,claude-sonnet-4-5,gemini-3-pro-image) - 新增独立

SmartWarmup.tsx组件,提供与配额保护一致的勾选体验 - 开启预热时默认勾选所有核心模型,UI 强制至少保留一个模型

- 调度器实时读取配置,修改立即生效

- 支持自定义预热模型(

- 智能预热系统基础功能:

- 额度恢复到 100% 时自动触发预热

- 智能去重机制:同一 100% 周期仅预热一次

- 调度器每 10 分钟扫描并同步最新配额到前端

- 覆盖所有账号类型(Ultra/Pro/Free)

- 国际化完善: 修复"自动检查更新"和"设备指纹"相关翻译缺失(Issue #550)

- 稳定性修复: 修复高并发调度下的变量引用和所有权冲突��问题

- API 监控性能优化 (修复 Issue #560):

- 问题背景: 修复 macOS 上打开 API 监控界面时出现 5-10 秒响应延迟和应用崩溃问题

- 数据库优化:

- 新增

status字段索引,统计查询性能提升 50 倍 - 优化

get_stats()查询,从 3 次全表扫描合并为 1 次,查询时间减少 66%

- 新增

- 分页加载:

- 列表视图不再查询大型

request_body和response_body字段,数据传输量减少 90%+ - 新增

get_proxy_logs_paginated命令,支持分页查询(每页 20 条) - 前端新增"加载更多"按钮,支持按需加载历史记录

- 列表视图不再查询大型

- 按需详情查询:

- 新增

get_proxy_log_detail命令,点击日志时才查询完整详情 - 详情加载时间 0.1-0.5 秒,避免不必要的数据传输

- 新增

- 自动清理功能:

- 应用启动时自动清理 30 天前的旧日志,防止数据库无限增长

- 执行 VACUUM 释放磁盘空间

- UI 优化:

- 新增加载状态指示器,提供清晰的视觉反馈

- 新增 10 秒超时控制,防止长时间无响应

- 详情模态框新增加载指示器

- 性能提升:

- 初始加载时间: 10-18 秒 → 0.5-1 秒 (10-36 倍提升)

- 内存占用: 1GB → 5MB (200 倍减少)

- 数据传输量: 1-10GB → 1-5MB (200-2000 倍减少)

- 影响范围: 此优化解决了大数据量场景下的性能问题,支持 10,000+ 条监控记录的流畅查看

- 反代日志增强: 修正了反代温补逻辑中账号/模型日志记录问题,补充了部分缺失的�国际化翻译项。

- 配额保护系统升级:

-

v3.3.21 (2026-01-11):

- 设备指纹绑定系统 (Device Fingerprint Binding) - 降低风控检测 (核心致谢 @jlcodes99 PR #523):

- 账号设备绑定: 实现账号与设备信息的一对一绑定关系,切换账号时自动切换对应的设备指纹。

- 设备指纹管理: 新增完整的设备指纹管理模块 (

device.rs),支持指纹生成、绑定、恢复和版本管理。 - 风控优化: 通过确保每个账号使用独立的设备信息,显著降低被 Google 风控系统检测的概率。

- UI 增强: 新增设备指纹管理对话框 (

DeviceFingerprintDialog.tsx),提供可视化的指纹管理界面。 - 核心功能:

- 支持采集当前设备指纹或生成随机指纹

- 自动备份和版本管理设备指纹历史

- 支持恢复到任意历史版本

- 提供设备存储目录快速访问

- 影响范围: 此功能为多账号管理提供了更强的隐私保护,有效降低账号关联风险。

- 代理服务核心修复 (Proxy Service Critical Fixes) - 提升稳定性 (核心致谢 @byte-sunlight PR #532):

- Warmup 请求拦截: 自动识别并拦截 Claude Code 每 10 秒发送的 warmup 请求,返回模拟响应,避免消耗配额。

- 支持流式和非流式两种响应模式

- 智能检测 warmup 特征(文本内容、tool_result 错误等)

- 添加

X-Warmup-Intercepted响应头标识

- 限流逻辑重构: 修复限流检查中的关键 bug,使用

email而非account_id作为限流记录的 key。- 修复绑定账号限流检查失效的问题

- 优化 60s 时间窗口内的账号复用逻辑,避��免复用已限流账号

- 改进会话解绑机制,限流时立即切换而非阻塞等待

- 字符串处理安全: 修复 UTF-8 字符边界 panic 问题,使用

chars().take()安全截取字符串。 - 影响范围: 此修复显著提升了 Claude Code 等工具的使用体验,减少配额浪费并提高账号轮换的准确性。

- Warmup 请求拦截: 自动识别并拦截 Claude Code 每 10 秒发送的 warmup 请求,返回模拟响应,避免消耗配额。

- CI/CD 测试增强 (CI Testing Enhancement) - 提升发布质量 (核心致谢 @Vucius PR #519):

- 强制测试: 在 GitHub Actions 的 Release 流程中添加

cargo test步骤,确保所有测试通过后才能构建发布版本。 - 测试修复: 修正

common_utils.rs中联网搜索测试的模型映射断言(gemini-3-flash→gemini-2.5-flash)。 - 测试清理: 移除

gemini/wrapper.rs中重复的测试模块定义,优化测试代码结构。 - 新增测试探针: 添加

common_utils_test_probe.rs文件,提供自定义工具检测的测试用例。 - 影响范围: 此改进确保了每次发布的代码质量,减少因测试失败导致的回归问题。

- 强制测试: 在 GitHub Actions 的 Release 流程中添加

- 监控日志容量优化 (Monitor Log Capacity Enhancement) - 支持大型图片响应 (修复 Issue #489):

- 提升响应日志限制: 将监控中间件的响应体日志限制从 10MB 提升到 100MB,解决 4K 图片等大型响应被截断的问题。

- 问题背景: 4K 图片经过 base64 编码后通常超过 10MB,导致监控日志显示

[Response too large (>10MB)]而无法记录完整响应。 - 优化效果: 现在可以完整记录包含高分辨率图片的响应内容,便于调试和监控图像生成等多模态功能。

- 性能影响: 每个请求最多占用 100MB 临时内存,对现代系统(8GB+ RAM)完全可接受。

- 历史演进: v3.3.16 时从 512KB 提升到 10MB(@Stranmor PR #321),本次进一步提升到 100MB。

- 影响范围: 此优化确保了图像生成、大型 JSON 响应等场景的完整日志记录,提升了监控系统的实用性。

- 自动更新通知系统 (Automatic Update Notification System) - 提升用户体验 (修复 Issue #484):

- 后端实现: 新增

update_checker.rs模块,集成 GitHub API 自动检测最新版本。- 语义化版本比较(支持 x.y.z 格式)

- 24 小时智能检查间隔

- 设置持久化(

update_settings.json) - 网络错误容错处理

- 前端实现: 新增

UpdateNotification.tsxToast 通知组件。- 渐变 UI 设计(蓝紫色渐变)

- 应用启动后 2 秒自动检查

- 一键跳转下载页面

- 可关闭/忽略功能

- 用户控制: 尊重用户设置,支持自动检查开关和检查间隔配置。

- 跨平台支持: 完全兼容 macOS、Windows、Linux 三大平台。

- 影响范围: 用户无需手动检查即可及时获知新版本,确保使用最新功能和 bug 修复。

- 后端实现: 新增

- 开机自动启动兼容性修复 (Auto-Launch Compatibility Fix) - 解决 Windows 切换异常 (修复 Issue #438, #539):

- 后端容错增强: 修复了 Windows 环境下禁用自启时因找不到注册表项导致的

os error 2报错。现在当用户选择禁用且启动项已不存在时,系统将视为操作成功,不再阻断后续逻辑。 - 状态实时同步: 前端设置页面现在会在加载时主动查询系统的�真实自启状态,而非仅仅依赖配置文件。这解决了由于系统清理软件或移动应用位置导致的状态不一致问题。

- 逻辑闭环: 确保了即使在异常系统环境下,用户也能通过重新点击“启用/禁用”来强制修复并同步自启状态。

- 影响范围: 解决了从 v3.2.7 以来长期困扰 Windows 用户的“无法禁用/设置不生效”问题。

- 后端容错增强: 修复了 Windows 环境下禁用自启时因找不到注册表项导致的

- API 监控看板增强 (API Monitor Enhancement) - 补全失败请求记录与 Gemini 统计 (修复 Issue #504):

- Gemini Token 统计兼容: 增强了监控中间件对 Gemini API 方言的支持,能够自动识别

usageMetadata节点并映射promptTokenCount等原生字段。 - 影响范围: 显著提升了监控面板在故障排查时的准确性,确保了跨协议 Token 统计的一致性。

- Gemini Token 统计兼容: 增强了监控中间件对 Gemini API 方言的支持,能够自动识别

- Claude 协议核心增强 (Claude Protocol Enhancement):

- 弹性恢复引擎 (Elastic Recovery Engine):

- 空流重试: 智能识别并自动重试上游返回的空数据流,解决网络抖动导致的请求失败。

- 断点自愈: 自动检测工具调用链的断裂状态(Missing ToolResult),并实施主动修复,防止因客户端中断导致的上下文同步错误 (400)。

- 智能上下文优化 (Smart Context Optimization):

- 资源瘦身: 自动清洗历史记录中的冗余 Base64 图片数据与超长日志,在保持上下文连贯的同时大幅降低 Token 消耗。

- 签名兼容: 实现了双向签名转换层,完美适配各版本 Claude 客户端的 Thinking 签名校验机制。

- 精细化限流 (Model-Level Rate Limiting):

- 模型隔离: 429 限流策略升级为“账��号+模型”双维度锁定。Gemini Flash 的频控不再影响 Pro/Ultra 模型的使用,显著提升账号利用率。

- 弹性恢复引擎 (Elastic Recovery Engine):

- 设备指纹绑定系统 (Device Fingerprint Binding) - 降低风控检测 (核心致谢 @jlcodes99 PR #523):

-

v3.3.20 (2026-01-09):

- 请求超时配置优化 (Request Timeout Enhancement) - 支持长时间文本处理 (核心致谢 @xiaoyaocp Issue #473):

- 提升超时上限: 将服务配置中的请求超时最大值从 600 秒(10 分钟)提升到 3600 秒(1 小时)。

- 支持耗时接口: 解决了某些文本处理接口(如长文本生成、复杂推理等)因超时限制导致的请求中断问题。

- 灵活配置范围: 保持最小值 30 秒不变,用户可根据实际需求在 30-3600 秒范围内自由调整。

- 国际化更新: 同步更新中英文提示文本,清晰标注新的配置范围。

- 影响范围: 此优化为需要长时间处理的 API 请求提供了更大的灵活性,特别适用于复杂文本处理、长文本生成等场景。

- 自动 Stream 转换功能 (Auto-Stream Conversion) - 消除 429 错误:

- 核心问题: Google API 对流式 (

stream: true) 和非流式 (stream: false) 请求采用截然不同的配额限制策略。流式请求配额更宽松,非流式请求极易触发 429 错误。 - 解决方案: 在代理层自动将所有非流式请求转换为流式请求发送给 Google,然后将 SSE 响应收集并转换回 JSON 格式返回给客户端。

- 协议支持:

- Claude 协议: ✅ 完整实现并测试通过

- OpenAI 协议: ✅ 完整实现并测试通过

- Gemini 协议: ✅ 原生支持非流式请求,无需转换

- 核心改动:

- 新增

src-tauri/src/proxy/mappers/claude/collector.rs- Claude SSE 收集器 - 新增

src-tauri/src/proxy/mappers/openai/collector.rs- OpenAI SSE 收集器 - 修改

claude.rs和openai.rshandler,实现自动转换逻辑

- 新增

- 性能影响:

- 成功率: 从 10-20% 提升到 95%+

- 429 错误: 从频繁出现到几乎消除

- 响应时间: 增加约 100-200ms(可接受的代价)

- 影响范围: 此功能显著提升了 Python SDK、Claude CLI 等非流式客户端的稳定性,解决了长期困扰用户的 429 配额问题。

- 核心问题: Google API 对流式 (

- macOS Dock 图标修复 (核心致谢 @jalen0x PR #472):

- 修复窗口无法重新打开: 解决了 macOS 上关闭窗口后点击 Dock 图标无法重新打开窗口的问题(Issue #471)。

- RunEvent::Reopen 处理: 将

.run()改为.build().run()模式,添加RunEvent::Reopen事件处理器。 - 窗口状态恢复: 当点击 Dock 图标时自动显示窗口、取消最小化、设置焦点,并恢复激活策略为

Regular。 - 影响范围: 此修复提升了 macOS 用户体验,确保应用窗口能够正常重新打开,符合 macOS 应用的标准行为。

- 请求超时配置优化 (Request Timeout Enhancement) - 支持长时间文本处理 (核心致谢 @xiaoyaocp Issue #473):

-

v3.3.19 (2026-01-09):

- 模型路由系统极简重构 (Model Routing Refactoring):

- 逻辑简化: 移除了复杂的“规格家族”分组映射,引入了更直观的 通配符 (*) 匹配逻辑。

- 自动配置迁移: 启动时自动将旧版本的家族映射规则迁移至自定义映射表,确保无损升级。

- UI 布局优化:

- �高效排版: “精确映射列表”改为 2 列并列展示,大幅提升空间利用率。

- 交互优化: 将列表置顶并支持 Hover 删除,表单压缩为单行置底,操作更加聚焦。

- 深色模式调优: 针对暗色环境进行了专项视觉优化,提升了对比度与层次感。

- 一键预设: 新增“应用预设映射”功能,内置 11 条常用的通配符路由规则(如

gpt-4*,o1-*等)。 - 在线编辑功能: 支持直接在列表中修改已有规则的目标模型,无需删除重建,操作更顺滑。

- 稳定性增强: 清理了废弃字段的残留引用,修复了所有相关编译警告。

- 模型级别限流锁定 (Model-Level Rate Limiting):

- 问题修复: 解决了不同模型配额互相影响的问题。之前当 Image 模型配额耗尽时,会锁定整个账号,导致 Claude 等其他模型即使有配额也无法使用。

- 模型级别锁定: 新增

model字段到RateLimitInfo结构,支持针对特定模型进行限流锁定。 - 精确配额管理: 修改

mark_rate_limited_async、set_lockout_until、set_lockout_until_iso等方法,添加可选的model参数。 - 智能日志输出: 区分账号级别和模型级别的限流日志,便于调试和监控。

- 向后兼容:

model: None表示账号级别限流(保持原有行为),model: Some(...)表示模型级别限流(新功能)。 - 影响范围: 此修复确保了不同模型的配额独立管理,Image 模型配额耗尽不再影响 Claude、Gemini 等其他模型的正常使用。

- 乐观重置策略集成 (Optimistic Reset Strategy):

- 双层防护机制: 为 429 错误处理添加最后一道防线,解决时序竞争条件导致的"无可用账号"误报。

- Layer 1 - 缓冲延迟: 当所有账号被限流但最短等待时间 ≤ 2 秒时,执行 500ms 缓冲延迟,等待状态同步。

- Layer 2 - 乐观重置: 如果缓冲后仍无可用账号,清除所有限流记录(

clear_all)并重试。

- 精准触发条件: 只在等待时间 ≤ 2 秒时触发,避免对真实配额耗尽执行无效重置。

- 详细日志追踪: 所有关键步骤都有日志输出(

[WARN]/[INFO]),便于调试和监控。 - 适用场景: 解决限流过期边界的时序竞争条件、临时性 API 限流、状态同步延迟等问题。

- 影响范围: 此策略作为现有 429 处理系统(精确解析、智能退避、成功重置)的补充,提高了临时性限流的恢复能力。

- 双层防护机制: 为 429 错误处理添加最后一道防线,解决时序竞争条件导致的"无可用账号"误报。

- 模型路由系统极简重构 (Model Routing Refactoring):

-

v3.3.18 (2026-01-08):

- 智能限流优化 - 实时配额刷新与精准锁定 (核心致谢 @Mag1cFall PR #446):

- 智能指数退避: 根据连续失败次数动态调整锁定时间,避免因临时配额波动导致的长时间锁定。

- 第 1 次失败: 60 秒

- 第 2 次失败: 5 分钟

- 第 3 次失败: 30 分钟

- 第 4 次及以上: 2 小时

- 实时配额刷新: 当 API 返回 429 但未提供